AI 治理是什麼?企業在 AI 時代必須回答的 3 個責任問題

AI 治理是什麼?企業在 AI 時代必須回答的 3 個責任問題

AI 治理(AI Governance)是指企業在使用 AI 系統時,如何設計責任歸屬、決策權與問責機制,而不只是資安或技術控制。

目錄

- 什麼是 AI 治理?為什麼它不是 IT 或資安問題

- 為什麼 AI 出事時,IT 無法承擔責任?

- AI 治理與 AI 資安有什麼不同?

- AI 治理一定要回答的 3 個核心問題

- 企業該如何開始做 AI 治理?

- 給 CTO / CISO / 董事會:如何用這三個問題檢查現況

- Appendix:AI 治理給董事會 / 風控的檢核清單

- 常見問題 Q&A

什麼是 AI 治理?為什麼它不是 IT 或資安問題

AI 資安,不是 IT 問題,而是數位員工的治理問題。

這一週,我連續寫了好幾篇關於 AI 資安的文章。有人私下問我:「是不是最近特別在意資安?」

其實不是。

因為這從一開始就不是資安的問題。而是當第一個「數位員工」被正式納入組織體系之後,治理卻仍停留在「工具與系統」時代,所產生的結構性落差。

AI 會讀資料、會做判斷、會執行行為。而任何被授權行動的存在,都不該只用 IT 的語言來理解。

這是一個治理問題。

為什麼 AI 出事時,IT 無法承擔責任?

過去,資安出事,通常有一條相對清楚的責任歸屬:

- 系統被駭了,是 IT 的問題

- 權限開太大,是設定失誤

- 資料外洩,是流程沒有被遵守

修補、檢討、寫報告,事情就算告一段落。

但 AI 出現之後,這條責任邊界第一次開始變得模糊。

因為 AI 不再只是「工具」,而是一個數位員工——能讀資料、能做判斷、能執行行為。

而對於員工,靠的從來不是 IT,而是治理。

真正的問題是——出事的那一刻,責任該落在哪裡?

以下每一個議題,我都另外寫成一篇實務文章:

- AI 治理下的技術失效案例:為什麼 Guardrails 擋不住 AI 攻擊?

- AI 資安的防禦極限:連 OpenAI 都擋不住的攻擊,你的防護能擋住嗎?

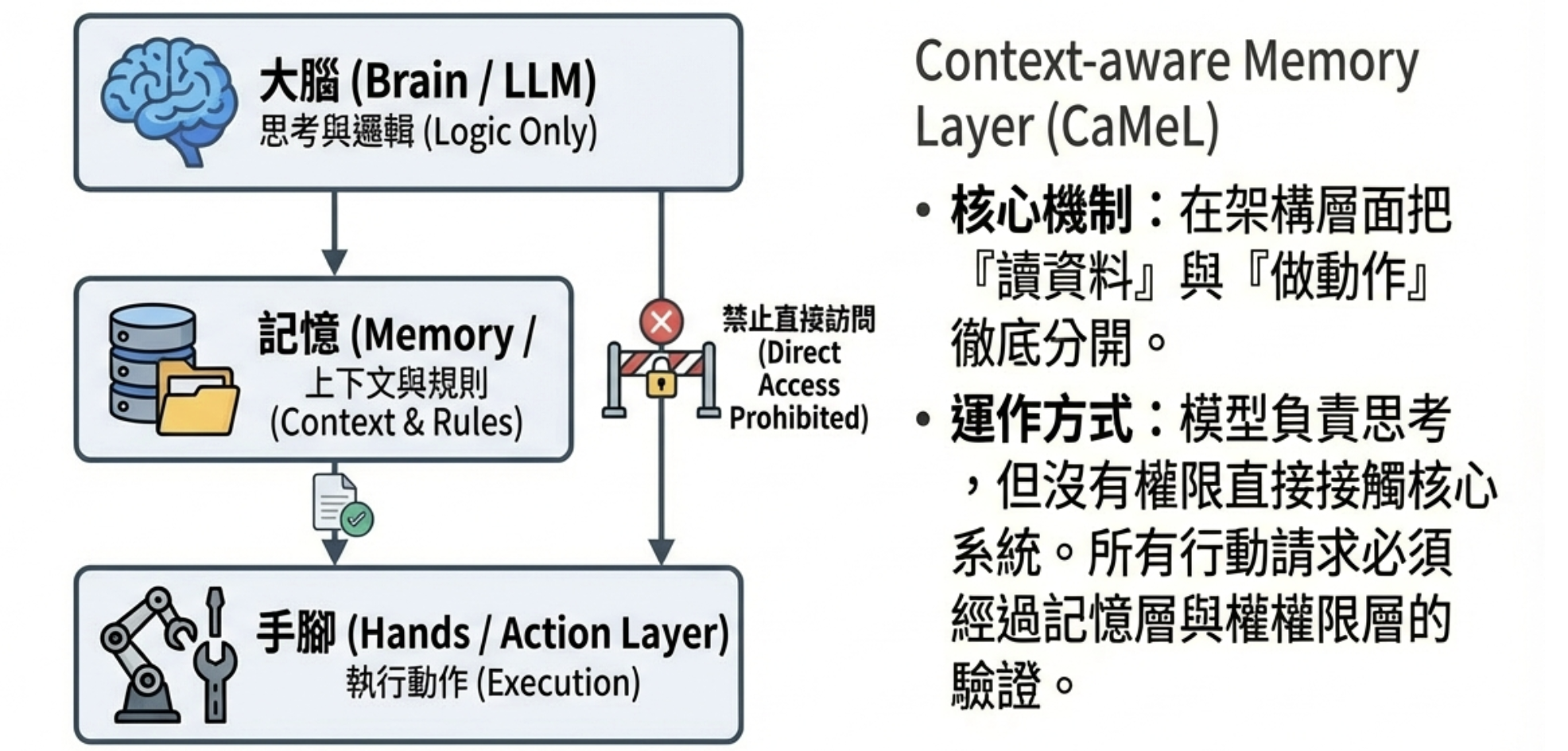

- AI 治理的技術實作:用 CaMeL 架構把「讀資料」與「做動作」徹底分開

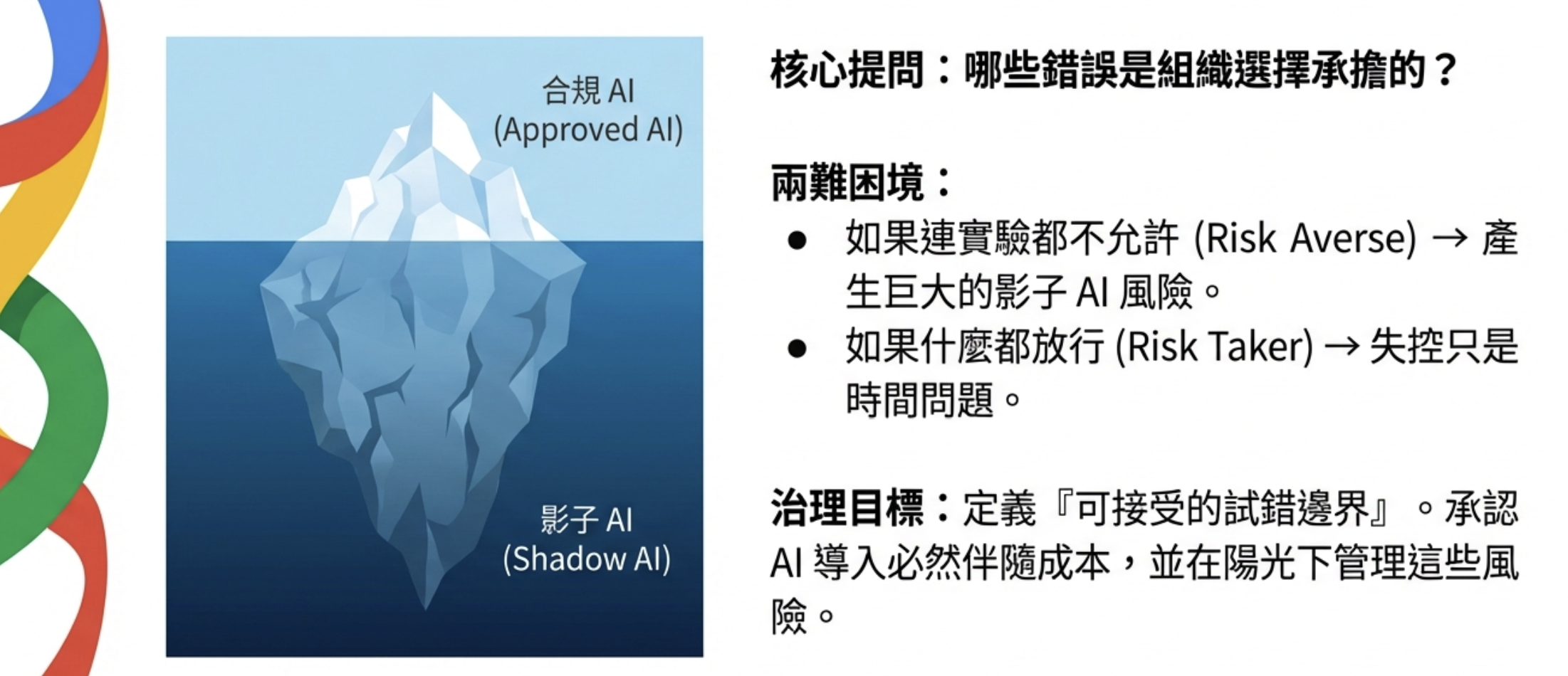

- AI 治理與現場落差:為什麼政策永遠被繞過?影子 AI 的必然出現

- AI 失控的真實案例:數字人主播在直播中突然學貓叫

- AI 治理的法規壓力:AI 基本法正式把「問責」寫進條文

- AI 資安的本質思考:效率、成本、風險之間的永恆取捨

從工具失效(Guardrails 擋不住)、到架構設計(CaMeL 讀寫分離)、到現場實務(影子 AI 為什麼一定會出現)、到真實案例(數字人主播學貓叫)、再到法規壓力(AI 基本法問責條款)——每一篇文章都在處理一個具體的面向。

但寫到這裡,我越來越清楚一件事:如果沒有治理,這些討論永遠拼不起來。

因為在 AI 時代,問題不再只是:

- 哪一個模型出錯

- 哪一行程式寫得不好

- 哪一條 policy 沒有遵守

而是更根本的問題:

AI 出事時,問題不再只是「哪裡壞了」,而是「誰允許它這樣做」。

這不是 IT 能單獨回答的問題。因為 IT 從來沒有被授權,去定義這些邊界。

AI 治理與 AI 資安有什麼不同?

AI 治理和 AI 資安常被混為一談,但本質完全不同。如果把視角拉到組織治理的語言,其實不管是企業治理、IT 治理,還是近年開始成形的 AI 治理,外部成熟框架大多都圍繞幾個核心面向在運作:

- 責任歸屬(Accountability)

- 決策權配置(Decision Rights)

- 風險承擔與容忍度(Risk Appetite)

- 控制與約束(Controls & Constraints)

- 透明度與可審計性(Transparency & Auditability)

- 合規與外部責任(Compliance & Liability)

這些概念並不新,也不是專為 AI 發明的。真正的變化在於——AI 讓這些治理問題第一次同時被放大、被具體化,而且無法再模糊帶過。

也正因如此,在 AI 時代,資安真正的核心不在於:

- 使用哪一個模型

- 採購哪一套工具

- 是否加上 guardrail

- policy 文件寫得多完整

而在於三個必須被清楚定義的治理問題。

AI 治理一定要回答的 3 個核心問題

一句話理解 AI 治理:

AI 治理不是防止 AI 出錯,而是當 AI 合法行動卻造成影響時,企業能否清楚說明:誰授權、誰負責、誰承擔。

哪些 AI 行為必須保留在人類決策層?

(Decision Rights / Accountability)

AI 到底是顧問,還是代理人?哪些行為只能建議,哪些才被允許執行?

這就是為什麼 CaMeL 架構 要把「讀資料」和「做動作」徹底分開——因為有些事情,AI 可以建議,但不能執行。

哪些 AI 錯誤是企業選擇承擔的?

(Risk Appetite / Accountability)

如果風險從來沒有被治理層承認,它就一定會以 影子 AI 或失控的形式出現。

如果連實驗都不允許,影子 AI 一定會出現;如果什麼都放行,那失控只是時間問題。

哪些 AI 行為必須在系統上被禁止?

(Controls / Auditability)

如果某件事在治理上被認定「不能發生」,那它就不該只靠 SOP,而是要在技術上做不到。

CaMeL、PostgresSQL RLS、權限分層、審計設計,其實都不是在「防 AI」,而是在具體化這三個治理決策。

企業該如何開始做 AI 治理?

AI 治理不需要從零開始建立完整框架。AI 不會等待治理成熟;法律也不會接受「我們還在研究」作為理由。

真正的風險,從來不是 AI 太快,而是組織遲遲不願意定義責任邊界。

給 CTO / CISO / 董事會:如何用這三個問題檢查現況

如果你是技術主管或董事會成員,以下是一個 15 分鐘的快速診斷方法:

Step 1:召集一場跨部門會議

邀請 IT、法務、業務單位主管,只問這三個問題:

- 「我們公司有哪些 AI 應用,是可以自己執行動作的?」

- 如果沒人能完整回答,代表連盤點都沒做。

- 如果答案是「只有 ChatGPT」,那你可能低估了現場的使用狀況。

- 「如果這些 AI 出事,誰要負責?」

- 如果答案是「IT」或「供應商」,這就是治理的缺口。

- AI 的行為授權者,才是責任歸屬的起點。

- 「這些 AI 被禁止做的事,是靠制度還是技術?」

- 如果答案是「有寫 SOP」,追問:「有人繞過 SOP 的話,系統會擋住嗎?」

- 如果系統不會擋,那這個「禁止」只是一個願望。

Step 2:根據答案,判斷治理成熟度

| 答案類型 | 治理成熟度 | 下一步行動 |

|---|---|---|

| 三題都答得出來,且有具體機制 | ⭐⭐⭐ 基本成熟 | 定期覆盤,準備外部審計 |

| 能答出一兩題,但沒有落實機制 | ⭐⭐ 有意識但有缺口 | 優先補齊責任歸屬與技術控制 |

| 大部分答不出來,或答案模糊 | ⭐ 尚未啟動 | 從盤點開始,先搞清楚現況 |

Step 3:把結論帶回董事會

不需要完整的治理框架,但至少要能說:

- 我們知道 AI 在公司裡做什麼

- 我們知道誰有權授權這些行為

- 我們知道哪些事是技術上做不到的,不是只靠制度

如果這三句話都說不出來,那「AI 治理」這件事,就還沒有真正開始。

這個系列的完整文章

如果你想深入了解每個面向,以下是完整的系列文章:

| 主題 | 核心問題 |

|---|---|

| AI Agent 安全性:遊戲規則已經改變 | 為什麼 Guardrails 註定擋不住? |

| AI Guardrails 為什麼註定失敗? | 連 OpenAI 都擋不住的攻擊 |

| CaMeL + PostgreSQL:當記憶與權限都在資料庫層實現 | 如何讓某些事「技術上做不到」? |

| 最小權限的現實:為什麼現場總是長出影子 AI | 為什麼政策永遠被繞過? |

| 數字人主播學貓叫:一場 Prompt Injection 的現場直播 | AI 失控可以有多荒謬? |

| 台灣 AI 基本法:工程師視角的解讀 | 法律如何定義 AI 的責任? |

| AI Coding 工具的資安風險 | 開發工具本身的風險在哪?(即將發布) |

| AI 時代的資安平衡 | 資安的本質是什麼? |

Appendix:AI 治理給董事會 / 風控的檢核清單

以下不是技術清單,而是一份治理成熟度的自我檢查。

一、責任與決策權

- AI 出事時,最終責任人是誰?

- 哪些行為 AI 只能建議,哪些可以執行?

- 是否存在明確禁止 AI 自主決策的行為清單?

二、風險承擔與試錯邊界

- 哪些錯誤是可接受的?哪些是不可承受的?

- 是否承認 AI 導入必然伴隨試錯成本?

- 是否已經出現影子 AI?

三、控制是否真正落到系統層

- 被禁止的行為,是靠制度,還是技術上做不到?

- 是否假設人一定會遵守流程,而非流程一定會被繞過?

四、透明度與可審計性

- 能否還原 AI 使用了哪些資料、做了哪些判斷?

- 是否具備不可變造的審計軌跡?

五、對外責任與合規準備度

- 是否能對監管機關、客戶、董事會清楚交代?

- 是否仍假設「不知道」可以免責?

常見問題 Q&A

Q: AI 治理是什麼?

AI 治理是指企業在使用 AI 系統時,如何設計責任歸屬、決策權限、風險承擔與問責機制,而不只是技術或資安控制。當 AI 成為「數位員工」,治理的核心問題變成:誰授權、誰負責、如何問責。

Q: AI 治理和 AI 資安有什麼不同?

AI 資安關注系統是否被攻擊、資料是否外洩;AI 治理關注的是當 AI 合法行動卻造成損害時,誰該負責。資安是技術問題,治理是組織設計問題。

Q: 為什麼說 Guardrails 擋不住 AI 攻擊?

因為 AI 的攻擊面是「語言本身」。多語種混雜、上下文誘導、角色扮演等攻擊方式,組合可能性幾乎無限。連 OpenAI 自己的防護都會被繞過,靠單一工具防禦是不夠的。

Q: 中小企業沒有資源做完整的 AI 治理,該怎麼辦?

不需要一步到位。先從三個問題開始:(1)哪些事 AI 絕對不能自己決定?(2)出事時誰負責?(3)有沒有辦法事後還原 AI 做了什麼?能回答這三個問題,就已經比大多數企業走得更前面。

Q: 影子 AI 是什麼?為什麼會出現?

影子 AI 是指員工未經公司授權,私下使用 AI 工具處理工作。出現的原因通常是:官方政策太嚴格、審批流程太慢、或根本沒有提供合適的 AI 工具。當效率需求與合規要求衝突時,影子 AI 幾乎必然出現。

Q: 台灣 AI 基本法對企業有什麼影響?

AI 基本法正式把「問責」寫進法律。這意味著「我們不知道 AI 會這樣做」將不再是有效的免責理由。企業必須能夠說明:誰授權 AI 做這件事、AI 用了哪些資料、為什麼會產生這個結果。

關於作者:

Wisely Chen,NeuroBrain Dynamics Inc. 研發長,20+ 年 IT 產業經驗。曾任 Google 雲端顧問、永聯物流 VP of Data&AI、艾立運能數據長。專注於傳統產業 AI 轉型與 Agent 導入的實戰經驗分享。

相關連結:

- 部落格首頁:https://ai-coding.wiselychen.com

- LinkedIn:https://www.linkedin.com/in/wisely-chen-38033a5b/