EU AI Act vs 台灣人工智慧基本法:企業 AI 合規差異一次看懂

2024 年歐盟通過全球第一部 AI 專法《AI Act》,2025 年底台灣三讀通過《人工智慧基本法》。表面上看,兩邊都在「管 AI」,但實際讀完法條,你會發現這是兩套完全不同的治理邏輯。

這篇文章不是法律評論,是從 IT 人的角度,拆解這兩部法規對企業實務的影響。如果你還沒看過台灣基本法的詳細解讀,建議先看台灣《人工智慧基本法》:IT 人該知道的事。

核心觀點: AI 治理不是 IT 問題,但 IT 人必須理解法規對技術架構的影響——因為最後要實作的是你。

本文比較 EU AI Act 與台灣人工智慧基本法,從風險分級、罰則、域外效力、企業 AI 合規實務四個面向,協助企業與 IT 團隊判斷現在該準備什麼、該做到什麼程度。

目錄

- TL;DR:給決策者的 60 秒重點

- EU AI Act 與台灣人工智慧基本法,核心差異是什麼?

- EU AI Act 的風險分級制度:企業 AI 合規一定會踩到的重點

- 台灣人工智慧基本法的風險分級:企業現在該怎麼準備?

- EU AI Act 罰則有多重?台灣人工智慧基本法會罰款嗎?

- 企業 AI 合規該怎麼做?EU AI Act vs 台灣基本法的義務差異

- 台灣公司需要遵守 EU AI Act 嗎?域外效力解析

- AI 監管機構比較:誰負責執法?

- EU AI Act 什麼時候生效?台灣 AI 基本法時程表

- 企業 AI 合規實務:IT 人現在該做什麼?

- 常見問題(FAQ)

- 總結:兩條路,同一個方向

TL;DR:給決策者的 60 秒重點

| 項目 | EU AI Act | 台灣 AI 基本法 |

|---|---|---|

| 狀態 | 已上路,有罰則 | 框架法,細則待訂 |

| 合規邏輯 | 照表操課 | 出事能否交代 |

| 會進歐盟市場 | 現在就要做高風險 AI 合規 | — |

| 只在台灣 | — | 先建 Audit Trail,等細則 |

一句話: 歐盟告訴你怎麼做,台灣要你自己證明有負責。不管哪邊,AI 治理的核心都是「可追溯、可問責」。

EU AI Act 與台灣人工智慧基本法,核心差異是什麼?

| EU AI Act | 台灣 AI 基本法 | |

|---|---|---|

| 合規邏輯 | Checklist 式——告訴你每一步怎麼做,不做就罰 | 責任式——不管你怎麼做,出事要能交代 |

| 監管風格 | 嚴格規範(Prescriptive) | 原則引導(Principle-based) |

| 罰則 | 最高 €35M 或全球營收 7% | 未規定,由各部會訂定 |

EU AI Act 的風險分級制度:企業 AI 合規一定會踩到的重點

兩部法規都採用「風險分級」的管理方式,但細節差很多。

EU AI Act 的四級風險分類

歐盟把 AI 系統分成四個等級,每個等級有明確的合規要求:

- Unacceptable(禁止):社會信用評分、操控性 AI、未經同意的生物辨識 → 直接禁止

- High(高風險):求職篩選、信用評估、醫療診斷 → 強制認證、風險評估、人工監督、Audit Trail

- Limited(有限風險):Chatbot、AI 生成內容 → 透明度義務(告知使用者這是 AI)

- Minimal(最低風險):垃圾郵件過濾、遊戲 AI → 幾乎不管

關鍵: 歐盟已經發布具體指引,告訴你哪些應用屬於哪個等級。2025 年 2 月起,禁止類別已經生效;2026 年 8 月,高風險系統的完整規範生效。

台灣人工智慧基本法的風險分級:企業現在該怎麼準備?

台灣同樣採用類似的四級架構(不可接受、高風險、一般風險、低風險),但有一個關鍵差異:

法條只給框架,細節由數位發展部和各部會後續訂定。

這代表什麼?代表現在你還不知道紅線在哪裡。

《人工智慧基本法》第 16 條明確授權數位部建立風險分類框架,但從法律通過到實際執行,還有 12-18 個月的空白期。

IT 實務影響:

- 歐盟:現在就可以開始對照 checklist 做合規

- 台灣:先建立基本的風險評估與 Audit Trail 機制,等細則出來再調整

EU AI Act 罰則有多重?台灣人工智慧基本法會罰款嗎?

EU AI Act 的罰則結構

歐盟的罰則是真的會痛:

- 使用禁止類 AI:€35M 或全球營收 7%(取高者)

- 違反高風險 AI 規定:€15M 或全球營收 3%

- 提供不正確資訊:€7.5M 或全球營收 1%

對大公司來說,7% 全球營收可能是數十億歐元。這不是開玩笑的數字。

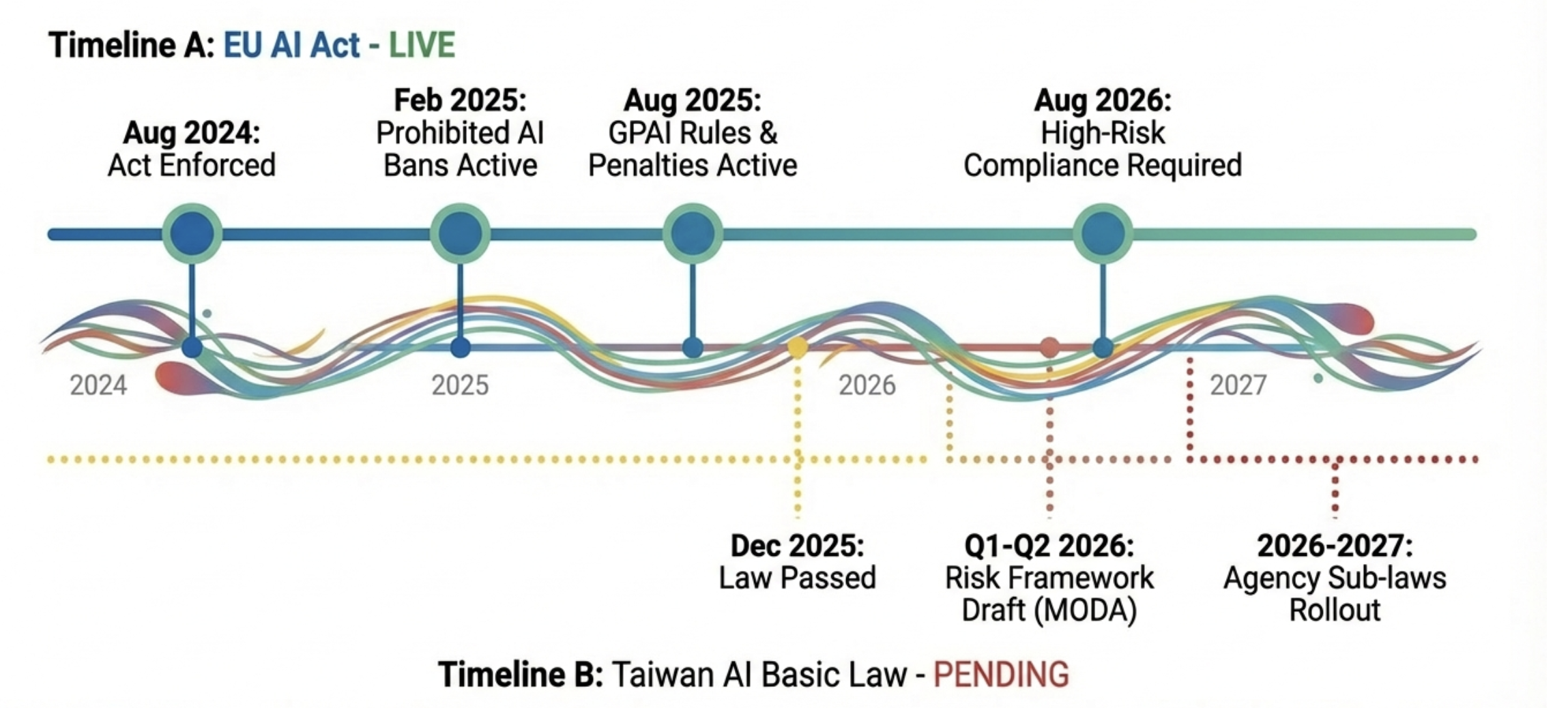

執行時間表:

- 2025/2/2:禁止類 AI 規範生效

- 2025/8/2:罰則機制生效

- 2026/8/2:高風險 AI 完整規範生效

台灣的罰則現況

《人工智慧基本法》本身沒有規定罰則。這不代表沒有法律責任——如果你的 AI 系統造成損害,還是會適用現有的民法、刑法、個資法等規定。但沒有像歐盟那樣針對 AI 的專門罰則。

一句話: 歐盟是「做錯就罰」,台灣是「出事再說」。

企業 AI 合規該怎麼做?EU AI Act vs 台灣基本法的義務差異

這是兩部法規最根本的差異。

EU AI Act:告訴你怎麼做

歐盟的高風險 AI 系統有明確的合規清單:

Provider(開發商)必須做到:

- ✅ 建立風險管理系統(貫穿整個產品生命週期)

- ✅ 資料治理(確保訓練資料品質)

- ✅ 技術文件(完整記錄系統設計與運作)

- ✅ 自動記錄功能(Audit Trail)

- ✅ 人工監督機制

- ✅ 準確性、穩健性、資安要求

- ✅ 上市前符合性評估

Deployer(使用企業)必須做到:

- ✅ 依照使用說明操作

- ✅ 指定負責人監督

- ✅ 確保輸入資料品質

- ✅ 監控系統運作

- ✅ 保存系統產生的 log

GPAI(通用 AI 模型)提供商必須做到:

- ✅ 公開訓練資料摘要

- ✅ 遵守版權規定

- ✅ 提供技術文件

- ✅ 超過 10^25 FLOPs 的模型:額外的對抗測試、事件通報、資安要求

台灣 AI 基本法:告訴你原則

台灣的七大原則我在前一篇文章已經詳細解讀過,這裡只列重點:

- 永續性:兼顧社會公平與環境

- 人類自主性:確保人為介入監督

- 隱私保護及資料治理:資料最小化原則

- 安全性:建立資安防護措施

- 透明及可解釋性:適當資訊揭露或標記

- 公平性:避免演算法偏差與歧視

- 可問責性:不同角色承擔相應責任

關鍵差異: 台灣的法條告訴你「要做到什麼」,但沒告訴你「怎麼做到」。這給了企業彈性,但也增加了不確定性。

台灣公司需要遵守 EU AI Act 嗎?域外效力解析

EU AI Act 的長臂管轄

歐盟的 AI Act 有域外效力(extraterritorial effect):

- 在歐盟市場銷售 AI 系統的企業

- AI 系統的輸出結果在歐盟境內被使用

- 即使你的公司不在歐盟,只要你的 AI 服務歐盟用戶,就適用

對台灣企業的影響: 如果你的產品或服務會進入歐盟市場,你需要符合 EU AI Act。

台灣 AI 基本法的適用範圍

台灣的基本法主要適用於國內。但有一個重要條款:

研發階段不適用,進入「實際環境測試」或作為「產品、服務」提供時才生效。

這代表你在實驗室裡怎麼搞都行,但一旦要上線或對外提供服務,就要符合規範。

AI 監管機構比較:誰負責執法?

EU AI Act 的雙層架構

歐盟層級:

- EU AI Office:監督 GPAI 模型合規

- European AI Board:跨國協調、確保一致解釋

國家層級:

- 各成員國指定市場監督機構

- 各成員國指定通報機構

台灣的主管機關

《人工智慧基本法》明定:

- 中央主管機關: 國科會

- 地方主管機關: 直轄市、縣市政府

- 風險分級框架: 由數位發展部訂定

這裡有一個潛在問題:國科會是科技研發導向的機構,主導 AI 治理是否適合,業界有不同看法。

EU AI Act 什麼時候生效?台灣 AI 基本法時程表

關鍵差異: 歐盟已經在執行,台灣還在建構。

企業 AI 合規實務:IT 人現在該做什麼?

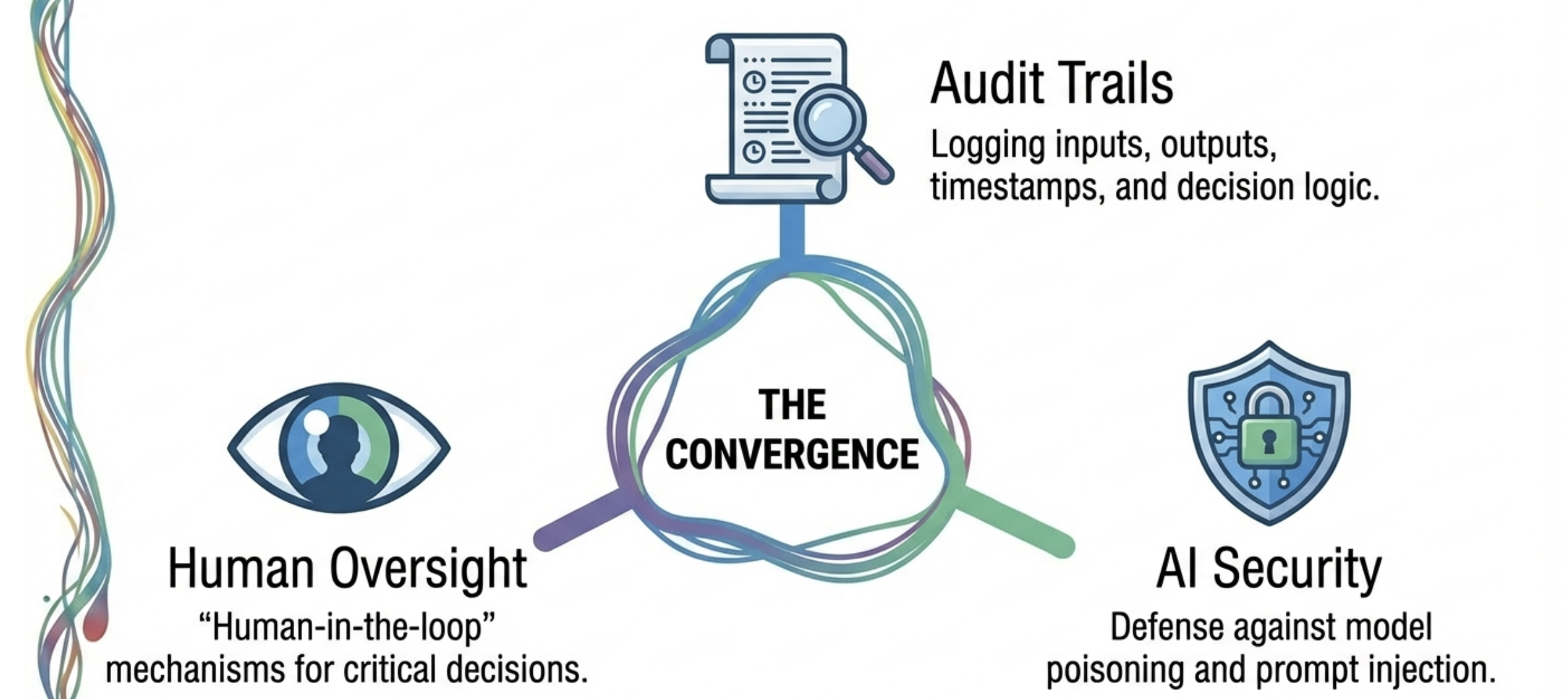

不論是歐盟還是台灣的法規,企業 AI 治理的核心都是相同的。在開始實務工作前,建議先用這三個問題檢查現況。

如果你的產品/服務會進入歐盟市場

現在就要做:

- 盤點你的 AI 系統屬於哪個風險等級

- 高風險系統:開始建立風險管理流程、Audit Trail、技術文件

- GPAI 使用者:確認供應商是否符合歐盟規範

- 禁止類應用:立即停止(已經生效)

如果你只服務台灣市場

現在可以做:

- 建立基本的 AI 使用盤點(哪些系統用了 AI、誰在用、做什麼)

- 建立 Audit Trail 機制(輸入、輸出、時間戳記、決策者)

- 指定每個 AI 系統的負責人(Owner)

- 制定內部 AI 使用規範

等細則出來後調整:

- 依據風險分級框架重新評估

- 高風險應用可能需要額外的合規措施

- 密切關注各部會的配套法規

通用建議

不管你的市場在哪裡,這些事情現在就該做:

| 優先級 | 行動項目 | 理由 |

|---|---|---|

| 立即 | 盤點現有 AI 應用 | 你要先知道自己在用什麼 |

| 立即 | 建立 Audit Trail | 兩邊法規都要求可追溯性 |

| 短期 | 指定每個 AI 系統的負責人 | 問責制的基礎 |

| 短期 | 制定內部 AI 使用規範 | 在法規細則出來前先有基本框架 |

| 中期 | 風險評估流程 | 等風險分級框架明確後執行 |

| 中期 | 供應商合規確認 | 你用的第三方 AI 是否符合規範 |

常見問題(FAQ)

Q: 台灣公司需要遵守 EU AI Act 嗎?

如果你的 AI 產品或服務提供給歐盟用戶,或 AI 輸出結果在歐盟境內被使用,即使公司不在歐盟,也可能適用 EU AI Act。這就是所謂的「域外效力」(extraterritorial effect),跟 GDPR 的邏輯類似。

Q: 台灣人工智慧基本法現在會罰款嗎?

基本法本身未設罰則。但這不代表沒有法律責任——若 AI 系統造成損害,仍可能適用民法、刑法、個資法等現行法律。未來各部會訂定的子法可能會有具體罰則。

Q: EU AI Act 對企業影響最大的部分是什麼?

對多數企業來說,高風險 AI 的合規要求會直接影響 IT 架構與開發流程。包括:強制建立 Audit Trail、風險管理系統、人工監督機制、技術文件等。這些不是選項,是強制要求。

Q: EU AI Act 什麼時候生效?

分階段生效:

- 2025/2/2:禁止類 AI 規範已生效

- 2025/8/2:GPAI 規範 + 罰則已生效

- 2026/8/2:高風險 AI 完整規範生效

Q: 台灣 AI 基本法的風險分級什麼時候會明確?

預估 2026 年 Q1-Q2 數位發展部會提出風險分級框架草案,2026-2027 年各部會配套子法陸續出台。在此之前,建議企業先建立基本的風險評估與 Audit Trail 機制。

Q: 我的 AI 應用屬於「高風險」嗎?

歐盟的高風險 AI 主要包括:求職篩選、信用評估、醫療診斷、執法、教育評分、關鍵基礎設施等領域的 AI 系統。台灣的分類細則尚未公布,但預計會參考歐盟框架。

總結:兩條路,同一個方向

| 面向 | EU AI Act | 台灣 AI 基本法 |

|---|---|---|

| 法律性質 | 具體執行法規 | 框架法(基本法) |

| 監管風格 | Prescriptive(規定式) | Principle-based(原則式) |

| 風險分級 | 已有具體指引 | 框架已定,細則待訂 |

| 罰則 | 明確且嚴厲(最高營收 7%) | 待各部會訂定 |

| 執行狀態 | 已開始執行 | 立法完成,執行待建構 |

| 合規邏輯 | 做錯就罰 | 出事要能交代 |

兩部法規的目標其實是一樣的:讓 AI 發展可信任、可問責。

差別在於歐盟用 checklist 管你,台灣要你自己想辦法證明「我有負責任地使用 AI」。

對 IT 人來說,不管法規怎麼寫,有幾件事是不變的:

- AI 不能成為新的資安破口

- AI 的決策要可追溯

- 出事時要有人負責,而且要能交代當時發生什麼

這些不是法規要求,是專業素養。法規只是把它寫成白紙黑字而已。

延伸閱讀

參考資料

- EU AI Act 官方法規全文 (EUR-Lex)

- EU Artificial Intelligence Act - High-level Summary

- EU AI Act Penalties

- 行政院:人工智慧基本法草案

- 關鍵評論網:人工智慧基本法三讀通過重點條文

- 台灣人工智慧學校:AI治理新紀元

- KPMG:解密歐盟人工智慧法案

免責聲明: 本人為 IT 專業背景,並非法律專業人士。本文是以我自己對法條的認知,加上 AI 輔助整理而成,目的是幫助 IT 人理解法規對技術實務的影響。如果你的企業需要正式的合規評估或法律意見,建議還是找適合的法務合作夥伴。

本文基於 2025 年 12 月資訊撰寫。歐盟 AI Act 持續有新指引發布,台灣配套子法也在制定中,實務要求可能調整。