GLM-5.1 實戰三週心得:$72 月費,拿到 95% 的 Opus 體驗

之前寫了 GLM-5 技術報告解讀 和 GLM-5.1 開源登頂 SWE-Bench Pro 兩篇,一篇拆架構、一篇看 Benchmark。

但說實話,Benchmark 看再多,跟你真的拿來用是兩回事。

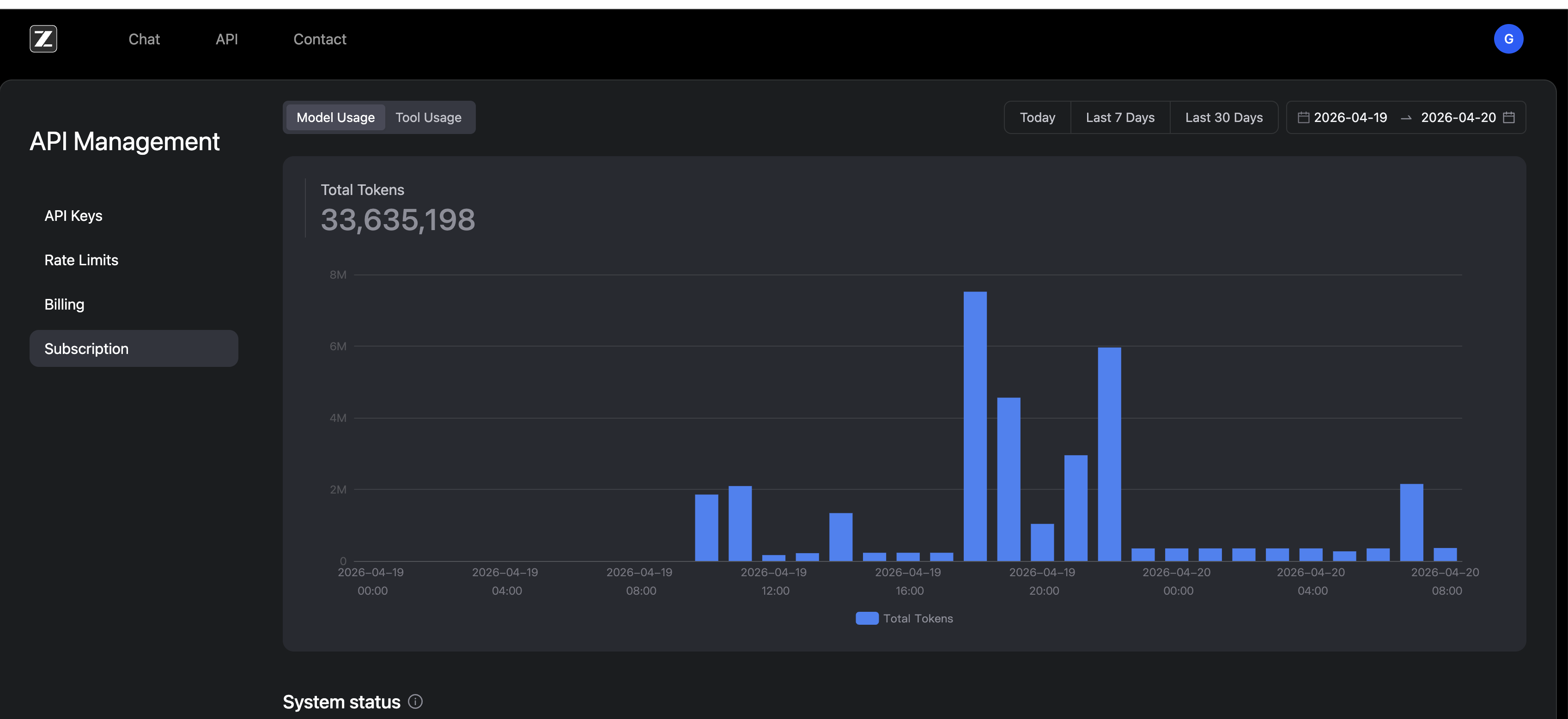

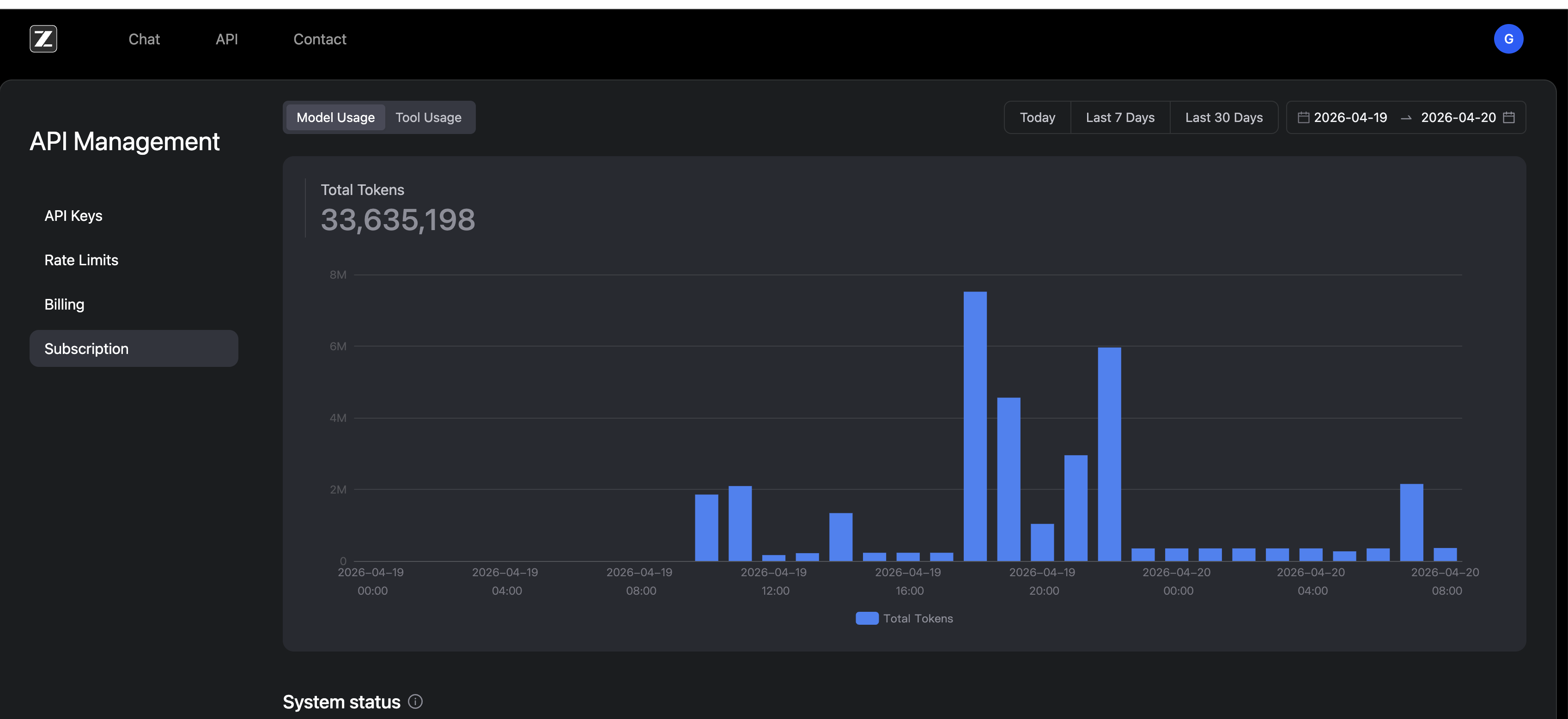

所以我做了一件事:透過 OpenRouter,把我其中一個 Workflow 裡的模型換成 GLM-5.1,直接在真實的 Agent 任務裡跑。跑了三週,昨天正式「畢業」——直接去買了國際版的 Coding Plan 月費服務。

為什麼要找替代方案

會開始認真測 GLM-5.1,不純粹是因為好奇。是因為最近 Claude 這邊的狀況讓我覺得需要一個 Plan B。

第一,Claude Code 最近蠻不穩定的。 尤其是 Opus 4.7 那個版本到底能不能用,社群裡的討論一直很分歧。有人說退步了,有人說還行,但整體來說你很難對它的品質有穩定的預期。當你的工作流程依賴一個模型,而這個模型的表現每次更新都在搖擺——這不是一個健康的狀態。

第二,Claude 的服務本身最近也不太穩。 斷線、rate limit、回應速度波動——這些事情如果偶爾發生你可以忍,但如果頻率高到影響工作節奏,你就會開始想:我是不是應該有個備案?

第三,GLM-5.1 的 Coding Plan 看起來真的不錯。 月費 $72,而且是無限量使用。對比 Claude Max 的 $200,這個價格很有競爭力。而且它可以直接整合到 OpenClaw 裡面,不需要額外的費用——月費內就包含了。

這三件事加在一起,讓我決定認真做一次測試。

從 OpenRouter 測試到正式購買的過程

我的做法是這樣的:不直接買月費,先用 OpenRouter 的 API 把 GLM-5.1 接進我現有OpenClaw 的 Workflow。這樣做的好處是你可以隨時切回原本的模型,風險很低——如果不行,一行設定改回來就好。

三週下來,我在這個 Workflow 裡拿 GLM-5.1 做了各種複雜的事情,一直到昨天確認:這東西可以用,而且用得好。

所以昨天我做了第二步:直接購買 GLM-5.1 國際版的 Coding Plan。月費 $72。

Coding Plan 是月費制的好處在於你不用再「省著用」。API 按量計費會讓你遇到複雜任務時猶豫——這個要跑多少 token?要不要先用便宜的模型試?月費制讓你放心把它當主力跑。

當然價格不是唯一考量——如果能力差太多,便宜也沒意義。三週的 OpenRouter 測試期就是在驗證這件事。

三週使用的真實體感

跟 Opus 4.6 的差距:有,但微小

先講結論:大概 95% 的 Opus 4.6 體驗。

這個 95% 怎麼理解?就是大部分日常的 Agent 任務——寫程式、改 bug、分析文件、生成報告——GLM-5.1 做得跟 Opus 差不多好。你不會覺得「啊這個模型比較笨」。

那缺的 5% 在哪?讓我用一個具體的場景來說明。

我每天拿它當數位秘書用。它要做的事情是把 Gmail、Calendar、Todo 這些零散的東西整合在一起,融合成一份每日建議報告——不只是列清單,而是根據上下文給出優先級建議、提醒衝突、建議行動。

這個任務 GLM-5.1 做得很好。10 個建議裡面,大概有 9 個跟 Opus 4.6 給出的品質差不多。但偶爾——大概 10 次裡有 1 次——Opus 會突然靈光一閃,跑出一個你沒想到但確實很有洞察的建議。GLM-5.1 在這種時候給的建議不是錯的,就是比較中規中矩、比較「安全」。

但這是非常邊緣的差距了。日常工作中,90% 的時候你感受不到差異。

實際做了什麼

三週裡我拿 GLM-5.1 做的事情包括但不限於:

- 數位秘書

- Blog 文章生成與編輯

- 程式碼重構和 bug 修復

- 資料分析腳本

- 系統架構文件撰寫

- 多步驟的自動化工作流

量不少,複雜度也不低。不是那種「寫個 hello world 然後說好棒棒」的測試。是真的拿來做生產工作的。

補充一下:有些時候為了省錢,我也會把比較小的任務或是 sub-agent 交給 GLM 1.5 Turbo 來處理。附帶一提,這個模型是智譜專門為 OpenClaw 特製的 GLM 5.0 特製化版本——不是一般的 GLM,是針對 Agent 場景優化過的。主力用 GLM-5.1,輕量任務分給 GLM 1.5 Turbo,這樣搭配下來成本控制得很好。

穩定性

這個要特別提。三週透過 OpenRouter 跑下來沒遇到什麼斷線或奇怪的 error。穩定性至少在我使用期間是合格的。

跟 MiniMax 的比較

在用 GLM-5.1 之前,我也花了不少時間測 MiniMax 的模型——M2.5 和 M2.7 都跑過。

老實說,MiniMax 那時候也給我不錯的感覺。但最後做比較的時候,GLM-5.1 真的是明顯比 KIMI 和 MiniMax 都好。

不是「好一點點」,是你能感覺到差距的那種好。

這跟 Benchmark 上看到的結果是一致的——GLM-5.1 在 SWE-Bench Pro 登頂不是灌水,實際用起來確實有那個水準。

地端部署的可能性

這是我最想講的部分。

GLM-5.1 全量開源、MIT License。如果你有足夠的硬體,理論上你可以完全在自己的機器上跑這個模型——不需要任何 API 呼叫,資料完全不出你的環境。

我甚至想建議一些朋友:如果你們在評估地端 Agent 模型,GLM-5.1 應該是目前最值得考慮的選項。

原因很簡單:它的能力已經到了可以做我們期待地端 Agent 做的所有事情的程度。 不是「堪用」,是「真的能用」。

但有個現實問題

硬體門檻。

GLM-5.1 是 744B 參數的 MoE 模型。即使跑量化版本,你大概需要新台幣三四百萬的 GPU 才撐得起來。

而且這還不考慮「買不買得到」的問題——目前高階 GPU 的供應狀況大家都知道。

所以對大多數團隊來說,短期內用 Coding Plan 或 API 還是比較務實的選擇。但至少現在你知道:有一個 Qualified 的開源模型存在,而且它的能力足以做數位員工的 baseline。

這件事本身就很有意義。一年前你找不到這樣的選項。

我的結論

| 面向 | 評價 |

|---|---|

| 與 Opus 4.6 的差距 | ~5%,日常幾乎感受不到 |

| 性價比 | Coding Plan $72/月 vs Claude Max $200/月 |

| 穩定性 | 三週無異常 |

| vs MiniMax / Kimi | 明顯勝出 |

| 地端可行性 | 能力足夠,硬體門檻高(~NT$300-400 萬 GPU) |

| 推薦程度 | 值得作為主力或備用 Agent 模型 |

三篇 GLM 文章寫下來——技術報告、Benchmark 登頂、實戰三週——我的觀察是一致的:GLM-5.1 是目前開源模型裡唯一一個你可以認真考慮拿來當生產環境 Agent 的選擇。

不是因為它便宜(雖然確實便宜),而是因為它的能力到了。

當然,5% 的差距在某些場景可能很關鍵。如果你做的事情需要那最後 5% 的推理深度,Opus 還是目前的天花板。但如果你的需求是「一個穩定可靠、能處理日常複雜任務的 Agent 模型」——GLM-5.1 完全夠用,而且成本低到你不用猶豫。

系列回顧

- GLM-5 技術報告深度解讀:從 Vibe Coding 到 Agentic Engineering — 架構、訓練、Slime RL 框架

- GLM-5.1 開源登頂 SWE-Bench Pro — Benchmark 分析、後訓練管線、定價策略

- 本篇 — 實戰三週,真實使用體感與地端部署評估