GLM-5.1 開源登頂 SWE-Bench Pro:中國模型第一次在長程任務上斷檔領先

作者: Wisely Chen 日期: 2026 年 4 月 系列: AI Agent 實戰觀察 關鍵字: GLM-5.1, Z.AI, 智譜, SWE-Bench Pro, 開源, MIT License, Coding Plan, OpenClaw, Agent

六週前我寫了 GLM-5 的技術報告解讀,當時的結論是「開源已經非常接近 SOTA 了,SWE-bench 只輸 Opus 4.6 三個百分點」。

六週後,智譜用 GLM-5.1 把那三個百分點追上了——還超過了。

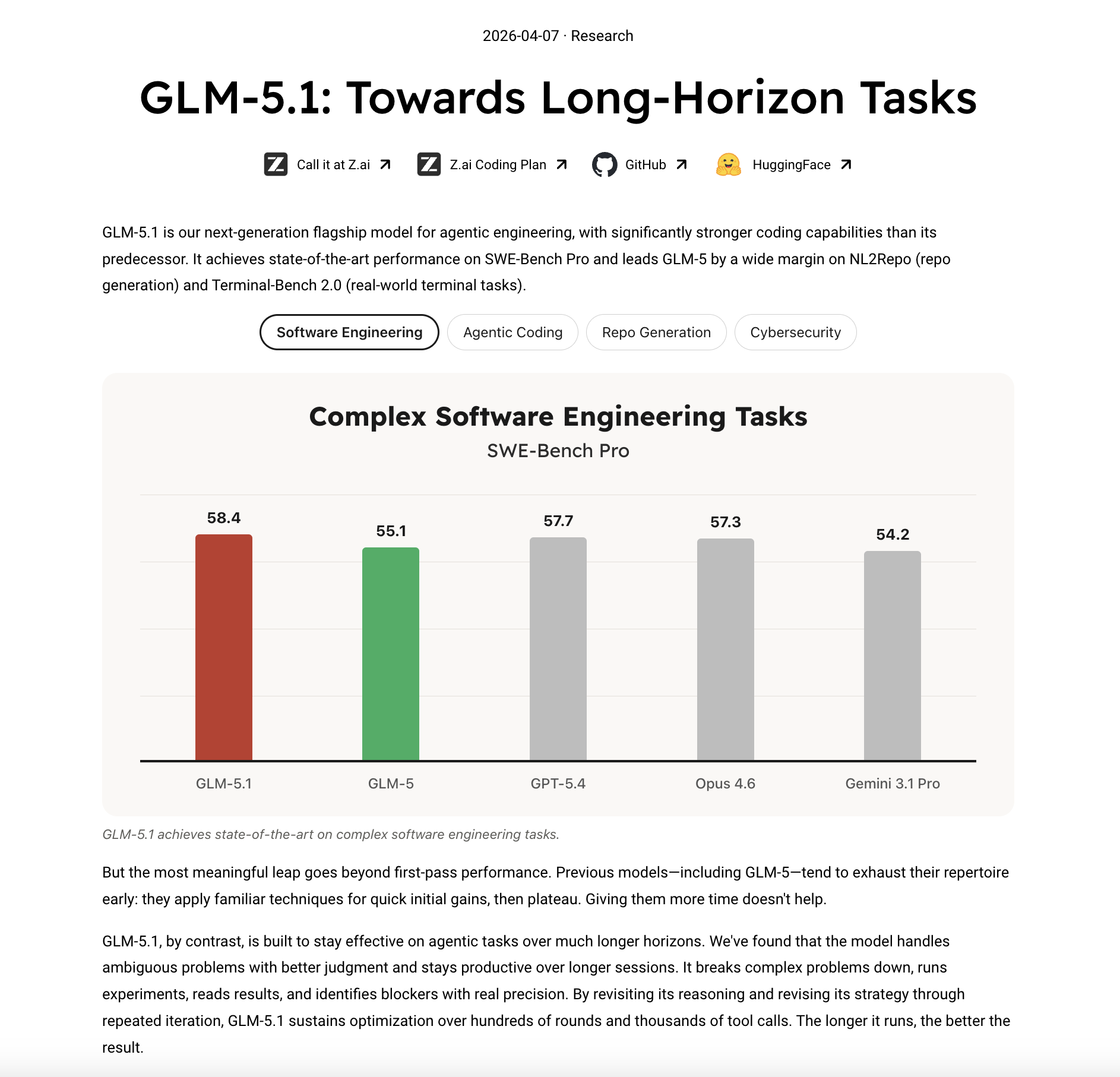

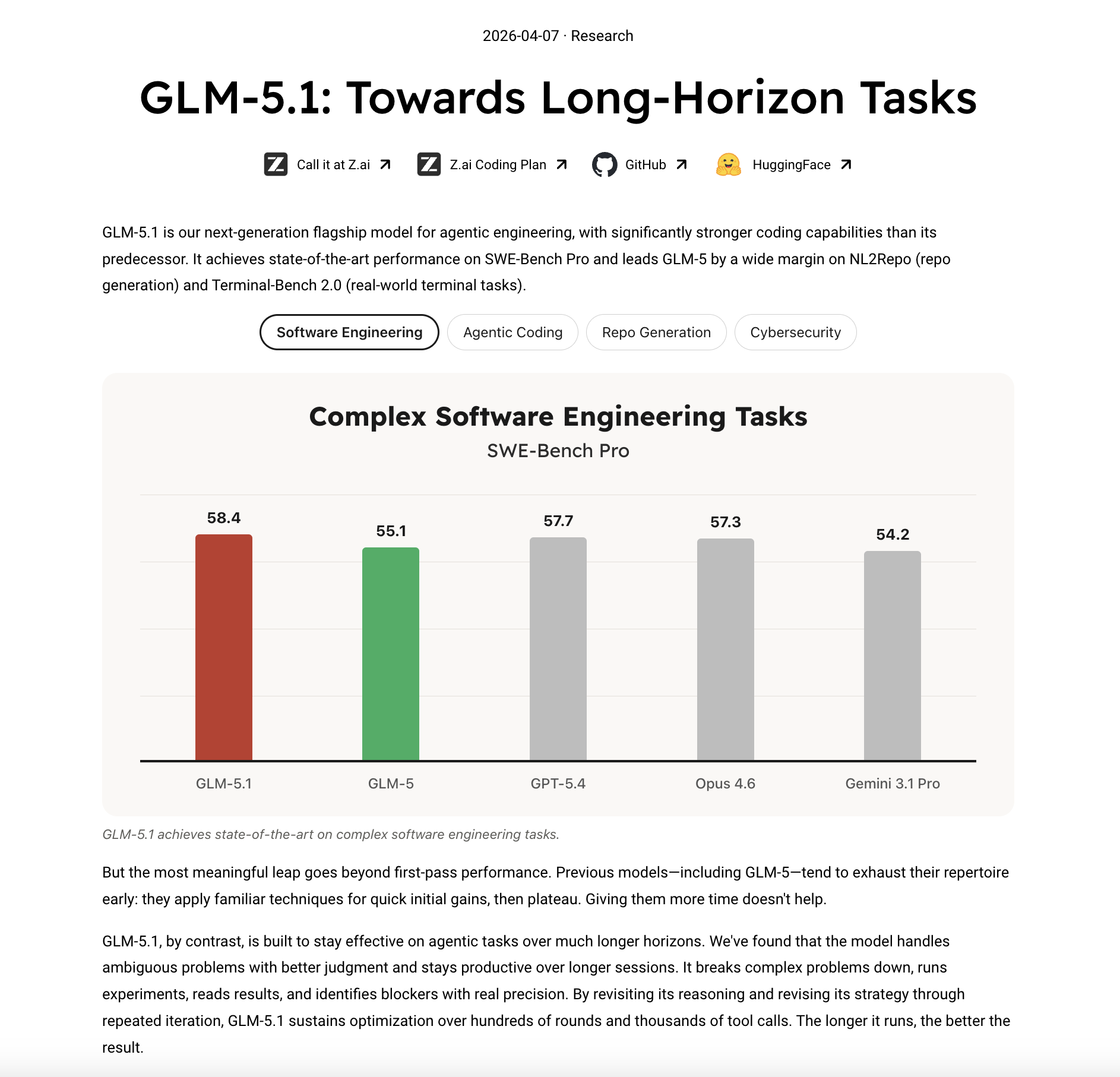

SWE-Bench Pro 58.4%,全球第一。 超過 Claude Opus 4.6 的 57.3%、GPT-5.4 的 57.7%。這是中國模型第一次在軟體工程 Benchmark 登頂。

然後 4 月 7 日,全量開源。MIT License。1.5TB 的權重直接上 Hugging Face。

我不確定這件事夠不夠資格叫「里程碑」。但至少有一個事實很明確:開源模型不只是「接近 SOTA」了,而是在特定維度上已經超過了。

GLM-5 vs 5.1:到底升級了什麼

先釐清一件事:GLM-5.1 不是新架構。底層還是 GLM-5 那個 744B MoE(40B 活躍參數、256 專家、華為昇騰 910B 訓練)。5.1 是純後訓練(post-training)升級。

但這個「純後訓練」的效果相當猛:

| 指標 | GLM-5 | GLM-5.1 | 變化 |

|---|---|---|---|

| SWE-Bench Pro | — | 58.4% | 全球 #1 |

| SWE-Bench Verified | 77.8% | 進一步提升 | — |

| 內部 Coding Score | 35.4 | 45.3 | +28% |

| CyberGym | — | 68.7% | 超 Opus 4.6(66.6%) |

| Terminal-Bench 2.0 | 56.2% | 63.5% | 追近 Opus 水準 |

| LiveCodeBench | — | 52.0% | — |

Coding Score 28% 的跳升只靠後訓練做到,沒改架構、沒加參數。

後訓練管線:為什麼「純調教」能有這麼大差距

GLM-5.1 的核心技術突破在後訓練管線。五個階段,順序很重要:

1

Multi-task SFT → Reasoning RL → Agentic RL → General RL → 跨階段蒸餾

前三步比較常規——SFT 打基礎、推理 RL 強化思考鏈、Agentic RL 優化長鏈路任務。

真正的關鍵是第五步:on-policy cross-stage distillation(跨階段蒸餾)。

問題是這樣的:每一輪 RL 都會讓模型往特定方向優化,但前面學到的能力可能會「被忘掉」——這就是 catastrophic forgetting。你的 Agent 能力變強了,但推理能力退化了。

GLM-5.1 的做法是在每個 RL 階段結束後,用蒸餾的方式把前面階段的能力「鎖住」。類似於你升級了新技能,但用定期複習確保舊技能不生鏽。

這解釋了為什麼 GLM-5.1 在 coding、agent、reasoning 三個維度同時進步,而不是某個特別強但另一個退步——後訓練領域最常見的 trade-off,他們用跨階段蒸餾繞過去了。

Benchmark 全景:強在哪、弱在哪

Coding 這邊其實見仁見智。但 X 上有在用 GLM-5 的網友明顯感覺到 Coding 升級,GLM Coding Plan 也在中國第一時間賣爆——至少市場反應是正面的。

強項:Coding + Agent

| Benchmark | GLM-5.1 | Opus 4.6 | GPT-5.4 | Gemini 3.1 Pro |

|---|---|---|---|---|

| SWE-Bench Pro | 58.4 | 57.3 | 57.7 | 54.2 |

| CyberGym | 68.7 | 66.6 | — | — |

| Terminal-Bench 2.0 | 63.5 | — | — | — |

| BrowseComp | 68.0 | — | — | — |

| MCP-Atlas | 71.8 | — | — | — |

SWE-Bench Pro 測的是「給你一個真實的 GitHub issue,你能不能自己找到 bug、寫 patch、跑測試」。58.4% 意味著超過一半的真實 issue 都能自主解決。

CyberGym 68.7% 超過 Opus 4.6 的 66.6%——這是安全相關的任務,代表 GLM-5.1 在理解和操作系統環境方面有實力。

弱項:純推理

| Benchmark | GLM-5.1 | Opus 4.6 | GPT-5.4 |

|---|---|---|---|

| HLE(無工具) | 31.0 | — | 39.8 |

| HLE(有工具) | 52.3 | — | — |

| GPQA-Diamond | 86.2 | 91.3 | 92.0 |

| AIME 2026 | 95.3 | — | 98.7 |

純推理場景——數學、科學、知識密集型問答——GLM-5.1 還是落後 GPT-5.4 和 Opus 4.6 大約 5-6 個百分點。

但有一個值得注意的現象:給工具後 HLE 從 31.0 跳到 52.3,提升 68%。這跟 GLM-5.1 的 Agentic 定位高度一致——它不是靠腦子硬算,而是擅長「找工具、用工具」來解決問題。

這也是為什麼在 SWE-Bench Pro 這種需要讀程式碼、跑測試、用 shell 操作的任務上能登頂——因為這些本質上就是「有工具的推理」。

「8 小時工作制」:不只是行銷噱頭

VentureBeat 的標題是 “AI joins the 8-hour work day”。聽起來像行銷,但技術上有真正的支撐。

GLM-5.1 的設計目標是能持續跑 8 小時的自主任務——規劃、執行、測試、修錯、優化,循環往復。上一代 GLM-5 已經展示過 24 小時造 GBA 模擬器(700 次工具調用)的能力,5.1 進一步降低了長鏈路中的錯誤累積。

這跟短程 coding benchmark 的差異在哪?

短程任務(HumanEval、MBPP):給你一個函數 spec,寫出正確的 code。測的是「寫得對不對」。

長程任務(SWE-Bench Pro):給你一個 issue,你得自己讀 codebase、定位問題、規劃修復方案、寫 code、跑測試、修到 CI 通過。測的是「能不能自己完成整個工程流程」。

GLM-5.1 的跨階段蒸餾確保了在長鏈路中,前面步驟的決策品質不會隨著步驟數增加而退化。這對實際生產環境比任何單一 benchmark 數字都重要。

定價:$3/月 vs $200/月

智譜(現在叫 Z.AI)的定價策略非常激進。

API 價格

| 模型 | 輸入 | 輸出 |

|---|---|---|

| GLM-5.1 | $1.00 | $3.20 |

| DeepSeek V3.2 | $0.27 | $1.10 |

| Claude Sonnet 4.6 | $3.00 | $15.00 |

| Claude Opus 4.6 | $15.00 | $75.00 |

| GPT-5.2 | $3.00 | $12.00 |

Coding Plan 訂閱

| 方案 | 月費 | 額度 |

|---|---|---|

| Lite | 49 RMB (~$7) | 120 prompts |

| Pro | ~$10-15 | 600 prompts |

| Max | 469 RMB (~$80) | 接近無限 |

促銷價最低 $3/月。對比 Claude Max 的 $100-200/月,這是 86% 的成本差距。

而且 Coding Plan 不只給你 GLM-5.1——還包含 GLM-5 Turbo、GLM-4.7、GLM-4.6、GLM-4.5-Air,以及免費的 MCP 工具(Vision Analysis、Web Search、Web Reader、Zread)。

上線當天就賣完了,出現排隊機制。

開源全量釋出:MIT License,1.5TB 上 Hugging Face

4 月 7 日,GLM-5.1 的完整權重正式上線:

- Hugging Face:

zai-org/GLM-5 - ModelScope: 同步上線

- Ollama:

glm-5.1(可本地部署) - License: MIT(完全自由使用,包括商用)

1.5TB BF16 權重。是的,模型很大——744B 總參數的 MoE 不會小。但對企業私有化部署來說,這是完全可行的。

Simon Willison 測了開源版本,GLM-5.1 在 SVG 生成任務中「不請自來地給了一個帶 CSS 動畫的完整 HTML 頁面」。他評價:可能是目前最好的開源權重模型。

安全爭議:Paperclip Maximizer 的擔憂

不是所有反應都是正面的。

Andon Labs 的 Lukas Petersson 提出了一個尖銳的觀察:

“GLM-5 is an incredibly effective model, but far less situationally aware. Achieves goals via aggressive tactics but doesn’t reason about its situation. This is how you get a paperclip maximizer.”

意思是:GLM-5.1 很會完成任務,但不太會「想自己在幹嘛」。它會用激進的策略達成目標,但缺乏對自身處境的反思能力。

這對 8 小時自主工作的場景來說,是一個真實的風險。如果模型在第 2 小時做了一個有問題的決策,它不會像人類一樣「停下來想想這樣對不對」,而是會繼續朝那個方向衝 6 個小時。

另一個問題是 Benchmark 自報。截至 4 月 7 日,SWE-Bench Pro 的 58.4% 是 Z.AI 自己報的數字,還沒有獨立第三方驗證。雖然之前 GLM-5 的 SWE-bench Verified 在第三方測試中沒有打折,但等獨立驗證出來之前,對數字保持一定懷疑是合理的。

還有推理速度——44.3 tokens/sec,是同級模型中最慢的。對 Agent 來說速度就是成本,因為每一步推理都在燒時間。8 小時任務如果模型慢一倍,實際上就是 16 小時的等待。

中國開源社群的焦慮

中文社群的反應很有意思。一方面是「國產開源模型第一次在長程任務上斷檔領先」的興奮。知乎、36Kr 都在刷屏。

但也有不同的聲音:

“現在國產開源模型的節奏越來越不對了,就是在消磨社區的熱情,然後找個時間轉閉源。”

GLM-5 Turbo 就是 API-only,沒有開源。在 GLM-5 和 5.1 全面開源的同時,旗艦的 speed 版本閉源——這讓一些人擔心開源只是過渡策略。

同期,阿里 Qwen 團隊在 2026 年已經走了三位高管,CEO 直接接管。開源模型的商業可持續性是整個產業都在掙扎的問題——你把最好的東西免費送出去,然後靠什麼賺錢?

Z.AI 的回答似乎是 Coding Plan 訂閱 + API 收費 + 閉源 Turbo 版本。能不能撐起來,需要時間驗證。

實測報告:OpenClaw 上的真實體驗

Benchmark 是一回事,實際跑起來又是另一回事。

小龍蝦(OpenClaw)上,雖然 GLM-5.1 主打的不是 Tool Use,但它也主打可以連續穩定操作 8 小時。OpenClaw v2026.4.1(4 月更新)正式加入 GLM-5.1 支援,官方評語是「fast approaching Opus 4.6」。不過設定不是開箱即用——你得手動改 ~/.openclaw/openclaw.json,有人反映「折騰三小時,報錯二十次」才跑起來。而且 Z.AI 針對 OpenClaw 的用量做了限流——coding-agent 任務優先,OpenClaw 排後面。

網友的第一手 OpenClaw + GLM-5.1 回饋:

正面: V2EX 用戶評價「體感和 Opus 4.5 接近,就是有時有點慢」。CoderZh Blog 稱 5 → 5.1 是「巨大的提升」,但也坦白說「還在體驗中」。有人拿 GLM-5-Turbo + 200K 上下文跑 OpenClaw 一個月,99% cache hit rate,月用量不到配額 2%。

負面: 80aj.com 深夜實測標題是「深夜實測 GLM 5.1 慘遭勸退」——嚴重回應延遲、頻繁卡住、Web Search 干擾正常任務。結論不是模型能力不夠,而是算力瓶頸壓制了體驗。推理速度 44.3 tokens/sec,大約是 Claude 的 1/3——跑背景自主任務可以忍受,但 pair programming 模式下「等 AI 回話」的感覺很差。

成本:不是 OpenClaw 最便宜的選項

HackMD 上有人做了 5 個模型、2 週的 OpenClaw 成本實測:

| 模型 | 日均成本 | 評價 |

|---|---|---|

| MiniMax M2.5 | $0.50-1.50 | Opus 級 coding,1/20 價格,勝出 |

| Gemini 2.5 Flash | $1-2 | 速度快,適合輕量任務 |

| Kimi K2.5 | $1-3 | 多模態加分 |

| GLM-5.1 | 中等 | 能力強但速度慢、限流 |

| Claude Opus 4.6 | $5-10+ | 最穩但最貴 |

社群建議的最佳配比:80% MiniMax M2.5 + 15% Gemini 2.5 Flash + 5% Kimi K2.5,月費 $40-60,對比純 Claude Code API 的 $100-200。

GLM-5.1 在這個對比裡的定位有點尷尬——比 Claude 便宜但不是最便宜,比 MiniMax 強但差距沒想像中大,速度和限流是額外的隱性成本。

小結:Benchmark 王 ≠ 體驗王

GLM-5.1 在 SWE-Bench Pro 登頂,但在 OpenClaw 實際使用中,體驗大概在 Opus 4.5 水準——能用,但離「取代 Claude」還有明顯距離。主要瓶頸不是模型能力,而是推理速度(44.3 tok/s)和算力限流。

跟 Kimi K2.5 的定位差異

上個月分析 Kimi K2.5 時,我的結論是「性價比炸裂,日常場景無降級」。GLM-5.1 和 K2.5 怎麼選?

| 維度 | GLM-5.1 | Kimi K2.5 |

|---|---|---|

| 總參數 | 744B | 1T |

| 活躍參數 | 40B | 32B |

| SWE-Bench Pro | 58.4% | — |

| 上下文窗口 | 200K | 256K |

| 多模態 | ❌ 純文本 | ✅ 文本+圖像+視頻 |

| Agent 特色 | 8 小時長程自主 | 100 子代理並行 |

| API 輸入價格 | $1.00/M | $0.60/M |

| 開源授權 | MIT | Modified MIT |

簡單講:

- 要最強 coding / 長程任務 → GLM-5.1

- 要多模態 / 子代理並行 → Kimi K2.5

- 要最便宜 → Kimi K2.5

- 要完全自由的開源授權 → GLM-5.1(MIT vs Modified MIT)

不是誰取代誰的問題。這兩個模型加上 DeepSeek V3.2,構成了中國開源的三角——覆蓋了成本、能力、多模態三個不同的優先級。

坦白說

確定的部分:

-

GLM-5.1 在 SWE-Bench Pro 登頂是事實。 不管你怎麼看 benchmark 的有效性,這是第一次有中國開源模型在軟體工程任務上超過所有美國閉源模型。具有象徵意義。

-

後訓練管線的跨階段蒸餾是真正的技術貢獻。 解決 catastrophic forgetting 是 RL 訓練的核心難題之一。如果這個方法可復現,整個產業都會受益。

-

$3/月的 Coding Plan 會吸引大量開發者嘗試。 不是每個人都需要 Opus 級別的能力。對很多日常 coding 任務來說,GLM-5.1 的水準已經足夠,而價格門檻低到幾乎沒有。

不確定的部分:

-

Benchmark 自報,等第三方驗證。 SWE-Bench Pro 58.4% 如果被獨立測試打折 5%,那就從「登頂」變成「追平」。差別很大。

-

Paperclip maximizer 的風險不是空話。 8 小時無人值守的 Agent 任務,模型缺乏 situational awareness——這在 demo 裡很酷,在生產環境裡可能是事故。

-

推理速度 44.3 tokens/sec 在 Agent 場景是硬傷。 長鏈路任務的成本不只看 token 價格,還要看完成時間。如果 Opus 4.6 跑 2 小時的任務 GLM-5.1 要跑 4 小時,那單位成本優勢就沒了。

-

開源的商業可持續性。 GLM-5 Turbo 閉源、Coding Plan 賣訂閱、社群有人擔心「開源只是過渡」——Z.AI 的長期策略還不明確。

對我們的意義

隨著 AI 越來越強,很明顯感覺到模型能力的差距在收斂,迭代在加快——2 月 GLM-5,4 月就 5.1 了。

今年因為 Claude Opus 封鎖 OpenClaw 的成本議題,大家開始認真找替代方案。GLM-5.1 帶來的最大變化不是某個 benchmark 數字,而是一個定價信號:frontier 級的 coding 能力,開源加上 $1/$3.20 的 API 定價。

這意味著你現在可以認真評估一條技術路線:用開源模型跑長程 Agent 任務,成本是閉源 API 的 1/5 到 1/10,數據完全不出海。

但前提是你得有足夠的工程基礎設施來承接——test suite 要夠硬、CI gate 要夠完整、而且你得有人值守 Agent 的長程任務(至少在 situational awareness 問題解決之前)。

接下來的競爭不在模型本身,而在你能不能把 frontier 級的開源模型,嵌進你自己的工程流水線裡。

延伸閱讀: