越級打怪的「神級小模型」:帶你認識 Qwen 3.5 與爆紅的 9B 架構

作者: Wisely Chen 日期: 2026 年 3 月 2 日 系列: AI 架構 關鍵字: Qwen 3.5, 9B, Small Language Model, Dense Architecture, Hybrid Attention, Gated Delta Network, Local LLM, Open Source

目錄

- 為什麼我要寫這篇

- Qwen 3.5 是什麼?30 秒速覽

- 9B 的成績單:數字說話

- 拆解黑科技一:混合注意力機制

- 拆解黑科技二:原生多模態的「早期融合」

- 拆解黑科技三:強化學習下放到小模型

- 關鍵決策:為什麼 9B 堅持 Dense 不用 MoE?

- 對企業本地部署的實際意義

- 坦白說

為什麼我要寫這篇

2026 年 3 月 2 日,阿里巴巴 Qwen 團隊釋出了 Qwen 3.5 系列的最後一波——Small 系列,包含 0.8B、2B、4B 和 9B 四個尺寸。

然後我的各種技術群組就炸了。

大家在討論的不是那個 397B 的旗艦大模型,而是那個「才 9B 參數」的小模型。原因很簡單:它在多項 benchmark 上打贏了上一代體積大 9 倍的 Qwen3-80B,甚至越級挑戰了 OpenAI 的 GPT-OSS-120B(體積大 13.5 倍)。

VentureBeat 的標題寫得很直白:「Alibaba’s small, open source Qwen3.5-9B beats OpenAI’s GPT-OSS-120B and can run on standard laptops。」

我之前寫過企業級地端 LLM 系統架構,也在本地 LLM 處理 Excel 那篇文章裡實際跑過 Gemma 3 的小模型。所以我對「小模型到底能做到什麼程度」這個題目,算是有一些實戰經驗。

今天就來拆解一下,Qwen 3.5-9B 到底在技術上做了什麼,才能越級打怪。

Qwen 3.5 是什麼?30 秒速覽

Qwen 3.5 是阿里巴巴 Qwen 團隊在 2026 年 2-3 月分三波釋出的開源模型系列,全部採用 Apache 2.0 授權。

三波釋出時間線:

| 日期 | 波次 | 模型 |

|---|---|---|

| 2/16 | 旗艦 | 397B-A17B(MoE,512 個專家) |

| 2/24 | 中型 | 27B、35B-A3B、122B-A10B |

| 3/2 | 小型 | 0.8B、2B、4B、9B |

核心賣點三個:原生多模態、混合注意力架構、為 Agentic AI 量身打造。

而 9B 就是這次小模型矩陣中的當紅炸子雞。

9B 的成績單:數字說話

先上硬數據,不帶情感色彩:

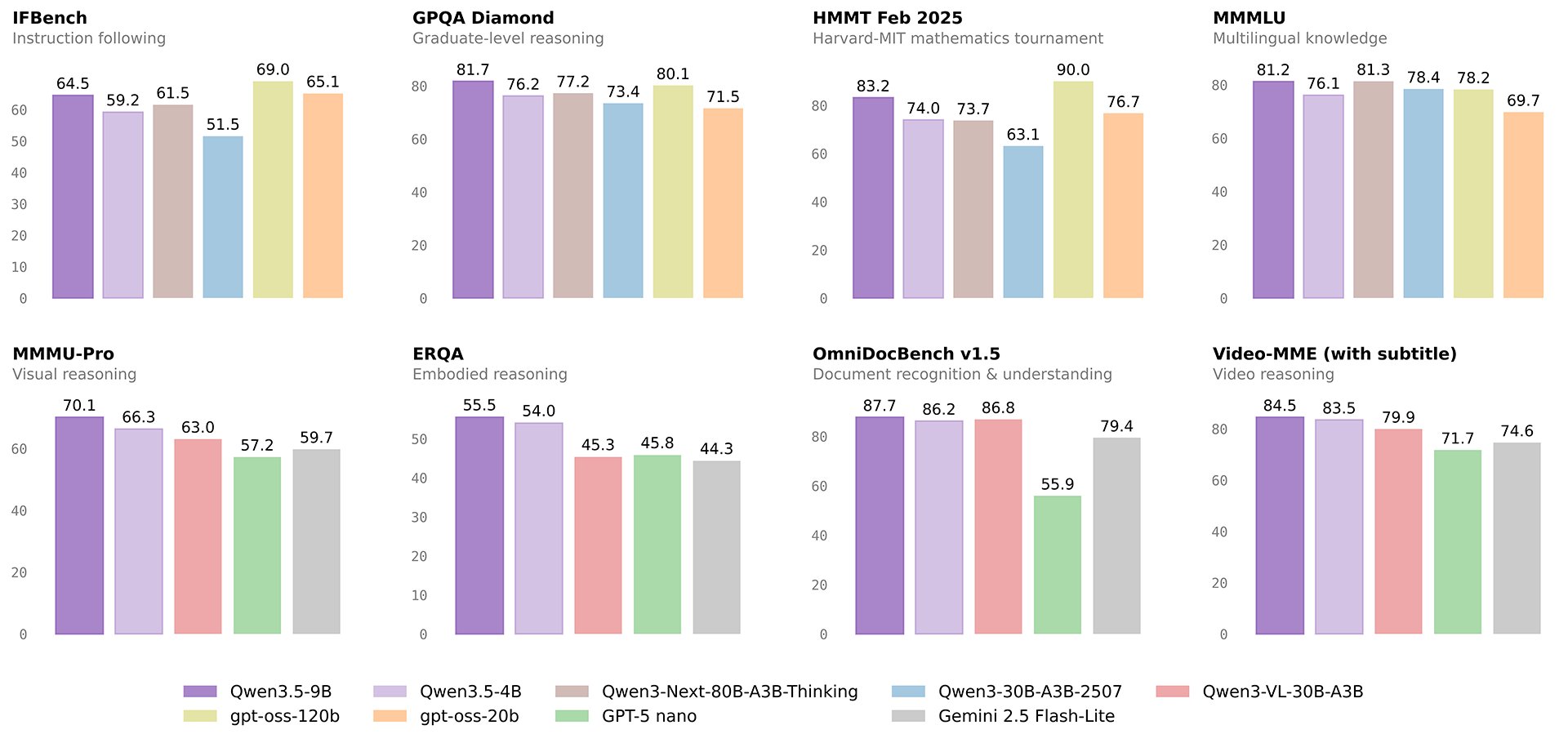

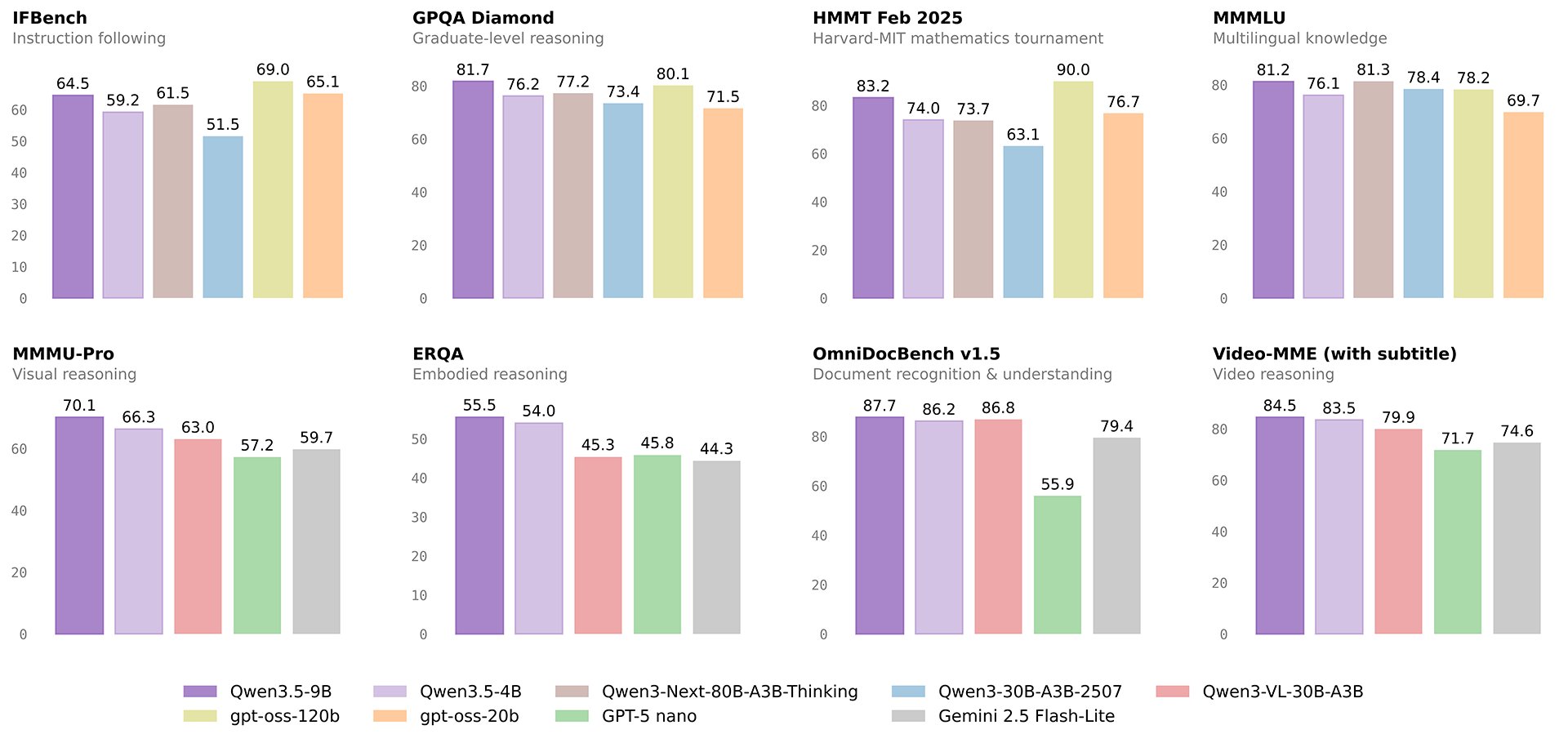

vs 上一代 Qwen3-80B(大 9 倍)

| Benchmark | Qwen3.5-9B | Qwen3-80B | 結果 |

|---|---|---|---|

| GPQA Diamond | 81.7 | 77.2 | 9B 贏 |

| IFEval(指令遵循) | 91.5 | 88.9 | 9B 贏 |

| LongBench v2(長文本) | 55.2 | 48.0 | 9B 贏 |

| MMLU-Pro | ~82.5 | ~82.5 | 平手 |

vs OpenAI GPT-OSS-120B(大 13.5 倍)

| Benchmark | Qwen3.5-9B | GPT-OSS-120B | 結果 |

|---|---|---|---|

| GPQA Diamond | 81.7 | 71.5 | 9B 贏 |

| HMMT Feb 2025(數學) | 83.2 | 76.7 | 9B 贏 |

| MMMU-Pro(多模態理解) | 70.1 | 59.7 | 9B 贏 |

| MMLU-Pro | 82.5 | 80.8 | 9B 贏 |

| MMMLU(多語言) | 81.2 | 78.2 | 9B 贏 |

這些數字不是「微幅領先」——在 MMMU-Pro 上是 70.1 vs 59.7,差了超過 10 分。用一個 9B 的模型打贏 120B 的模型,這在兩年前是不可想像的事。

所以問題來了:它怎麼做到的?

拆解黑科技一:混合注意力機制

這是 Qwen 3.5 整個系列最核心的架構創新,叫做 Gated Delta Network。

傳統的 Transformer 用的是「全注意力」(Full Attention)——每個 token 都要跟其他所有 token 做運算。這很精確,但代價是記憶體消耗隨序列長度呈二次方增長。簡單說:文本越長,越吃記憶體,越慢。

Qwen 3.5 的做法是:不全部用 Full Attention,改用 3:1 的混合比例——每 3 層線性注意力(Linear Attention),搭配 1 層標準注意力。

線性注意力的原理是把輸入壓縮成固定大小的狀態,複雜度從 O(n²) 降到接近 O(n)。這帶來的好處非常具體:

- 原生支援 262K tokens 上下文(約 20 萬字的中文)

- 可擴展到 100 萬 tokens

- KV-cache 記憶體消耗大幅降低

翻譯成人話:你可以把一整本書丟進去讓它分析,而不用擔心 OOM(記憶體爆掉)。

這不是什麼實驗室裡的論文概念。這是已經部署在從 0.8B 到 397B 的所有模型上的生產級架構。

拆解黑科技二:原生多模態的「早期融合」

過去的小模型通常是「先學文字,再外掛視覺」。就是先訓練一個純文字模型,然後再用 adapter 或 bridge 把圖像編碼器接上去。

Qwen 3.5 的做法不一樣:從訓練最早期開始,就把視覺和文字資料放在一起聯合訓練。

這種「打從娘胎裡就看著圖片學認字」的做法,結果反映在數字上:

- Video-MME(含字幕):84.5——一個 9B 的模型可以理解影片內容

- OmniDocBench v1.5:87.7——文件理解能力遠超 GPT-OSS-120B

- 甚至 0.8B 的最小模型都能處理影片——這是史上第一個能做到的 sub-1B 模型

為什麼「早期融合」這麼重要?因為它讓模型在底層就建立了視覺和語言之間的對應關係,而不是事後硬接。就像一個從小就在雙語環境長大的孩子,跟一個成年後才學第二語言的人,思維的流暢度完全不同。

拆解黑科技三:強化學習下放到小模型

這是最容易被忽略,但可能影響最大的一個技術突破。

過去,強化學習(RL)通常是大模型的專利。原因很簡單:RL 需要模型有足夠的「基礎能力」才能從反饋中學習。你不能教一個連基本加減法都不會的模型去解微積分。

但 Qwen 團隊做了一件事:把百萬級別的 Agent 環境強化學習技術,直接應用在 9B 的小模型上。

結果是:9B 獲得了強大的「自主拆解任務」能力。遇到複雜的數學或程式題,它不再只是「預測下一個 token」,而是能夠一步步推導邏輯,像人類一樣進行多步驟推理。

這反映在 HMMT Feb 2025 數學測試上:9B 拿到 83.2,打贏了 GPT-OSS-120B 的 76.7。一個 9B 的模型在數學推理上贏了一個 120B 的模型——這就是 RL 的威力。

關鍵決策:為什麼 9B 堅持 Dense 不用 MoE?

這個設計決策值得單獨拿出來講,因為它非常反直覺。

在 Qwen 3.5 的大家族中,大尺寸模型(35B、122B、397B)為了節省算力,大多採用 MoE(Mixture of Experts,專家混合)架構——比如 397B 實際上有 512 個專家,但每次只啟動 10 個,所以活躍參數只有 17B。

但 9B 反其道而行,採用了純粹的 Dense(稠密)架構。

什麼意思?就是每一次運算,這 90 億個參數全員出動。沒有「專家輪值」,沒有「部分休息」。

為什麼?

知識密度的極致壓縮

90 億參數在 BF16 下約佔 18GB 顯示記憶體,4-bit 量化後更只需要約 5GB。這個體積對現代硬體來說很輕巧。

採用 Dense 架構意味著:每一個參數都在每一次推理中發揮作用。 沒有浪費。

減少幻覺,增強邏輯

這是更重要的理由。MoE 架構的本質是「讓不同的專家處理不同的問題」。這很高效,但有個副作用:當路由機制判斷錯誤,把問題分配給了「不對的專家」,就容易產生幻覺。

Dense 模型沒有這個問題。所有參數都參與每一次推理,像是一整個團隊坐在一起討論,而不是只派一兩個人去開會。

在處理複雜數學和深度邏輯推導時,Dense 模型的表現通常比同等活躍參數的 MoE 模型更扎實、更不容易胡說八道。

這就是為什麼 9B Dense 能在 HMMT 數學測試上拿到 83.2 的高分。

對企業本地部署的實際意義

OK,講了這麼多架構,回到我比較關心的問題:這對想在本地端部署 AI 的企業來說意味著什麼?

我之前在企業級地端 LLM 架構那篇文章裡講過,企業選擇本地部署的核心原因通常不是性能,而是資料主權和信任。

Qwen 3.5-9B 的出現,讓「本地部署」的性價比方程式完全改變了:

硬體門檻大幅降低

| 精度 | VRAM 需求 | 對應硬體 |

|---|---|---|

| BF16(全精度) | ~18GB | RTX 3090 / RTX 4090 |

| 4-bit 量化 | ~5GB | RTX 3060 12GB / M1 Mac |

一張 RTX 3060 就能跑的模型,卻有接近上一代 80B 的能力。這代表什麼?代表你不需要一台 A100 伺服器,用一般的工作站甚至筆電就能做到。

三種跑法,對應三種預算

1. 完美無損運行(FP16 精度)

如果您想體驗 100% 滿血版、沒有任何壓縮的 9B 模型,模型本身大約會佔用 18GB 的顯示記憶體(VRAM),加上運算時的緩衝,通常需要 20GB 到 24GB 的 VRAM。

- Windows / Linux PC: 需要一張高階顯示卡,例如 NVIDIA RTX 3090、RTX 4090 或即將推出的 50 系列高階卡。

- Mac: 搭載 Apple Silicon(M1/M2/M3/M4 的 Pro/Max/Ultra 晶片),並且具備 32GB 以上統一記憶體的 MacBook 或 Mac Studio。

2. 高 CP 值流暢跑(INT8 輕度量化)

這是最多人選擇的方案。將模型壓縮到 8-bit 後,智商幾乎沒有衰退,但只需要約 10GB 到 12GB 的 VRAM 就能順暢運行,而且生成速度非常快。

- Windows / Linux PC: 只要有 NVIDIA RTX 3060 (12GB 版)、RTX 4070、4070 Super 等中階顯示卡就能輕鬆應付。

- Mac: 具備 16GB 統一記憶體的 Mac(就算是基礎版的 M 系列晶片也沒問題)。

3. 最低門檻極限跑(INT4 深度量化)

如果您的電腦比較舊,或是使用一般的電競筆電,可以選擇 4-bit 量化版本(如 GGUF 格式)。這個版本會犧牲一點點複雜的邏輯推理能力,但 VRAM 需求會降到只需 6GB 到 8GB。

- Windows / Linux PC: NVIDIA RTX 2060、3050、4060,甚至是很多電競筆電的獨立顯卡都能跑得動。

- 純 CPU 運行: 如果您完全沒有獨立顯卡,只要電腦有 16GB 以上的系統記憶體 (RAM),也可以單純靠 CPU 來硬跑,只是生成文字的速度會比較慢(可能像人類打字的速度)。

全平台即用

| 平台 | 狀態 |

|---|---|

| Hugging Face | 已上架 |

| Ollama | ollama run qwen3.5:9b |

| vLLM / SGLang | 官方推薦 |

| llama.cpp | 支援 |

| MLX(Apple Silicon) | 支援 |

Apache 2.0 授權意味著沒有商用限制。你想怎麼用就怎麼用。

262K 上下文 = 企業級應用門檻

262K tokens 的原生上下文窗口,大約等於 20 萬字的中文文件。這意味著:

- 可以把一整份法律合約丟進去分析

- 可以把幾萬行程式碼一次性餵進去

- 可以做跨文件的知識整合

而且這是「原生」支援,不是靠 RAG 外掛拼湊的。

坦白說

寫到這裡,我必須誠實講幾件事。

1. Benchmark 不等於實戰

CNBC 在報導中明確說了:「could not independently verify Alibaba’s benchmark claims」(無法獨立驗證阿里巴巴的 benchmark 宣稱)。

Benchmark 是廠商自己跑的。評測方法、prompt 格式、溫度設定、few-shot 數量⋯⋯這些都會影響成績。不同來源對同一個比較對象(比如 GPT-OSS-120B)報出了不同的分數,這本身就說明了問題。

所以那些「9B 打贏 120B」的標題,看看就好,不要照單全收。

2. 跑起來了,但還沒跑原本的場景實測

9B 我已經用 Ollama 拉下來跑起來了,基本的對話和推理確實很流暢。但之前在本地 LLM 處理 Excel 那篇文章裡用 Gemma 3 跑的那些場景——Excel 解析、結構化資料提取、多步驟推理——這些我還沒有拿 Qwen 3.5-9B 重新跑過。

所以這篇文章的架構分析是基於官方公布的技術資訊和 benchmark 數據,實際場景的對比實測等我跑完會另外寫一篇。

3. 「神級小模型」的稱號需要時間驗證

現在社群很興奮,這很正常。但歷史告訴我們,很多在 benchmark 上看起來很強的模型,到了實際應用場景就會暴露問題——可能是中文理解有偏差,可能是長文本推理掉鏈子,可能是 Agent 場景下的工具調用不穩定。

真正的「神級」需要時間和大量使用者的實戰驗證,不是靠 benchmark 表格封的。

4. 開源生態的真正意義

不過,即使打個折扣,Qwen 3.5-9B 的出現仍然意義重大。它證明了一件事:

「好的架構 + 高品質數據 + 優秀的強化學習」遠比單純把模型做大來得重要。

混合注意力機制(Gated Delta Network)、原生多模態早期融合、RL 下放到小模型——這三個技術突破,把過去只有大模型才玩得起的能力,塞進了一張 RTX 3060 就能跑的體積裡。

對於獨立開發者、學術研究者、或是想在本地端部署 AI 應用的企業來說,這是目前開源社群能拿到的最高性價比選擇之一。

至於它是不是真的「神級」?跑跑看再說吧。

延伸閱讀

- 企業級地端 LLM 系統架構藍圖 — 為什麼企業要本地部署,以及怎麼建

- 本地 LLM 處理 Excel 的正確姿勢 — 用 Gemma 3 小模型做 Excel 解析的實戰

- 2026 農曆新年,中國開源大模型集體爆發 — Kimi、Qwen、GLM、MiniMax 怎麼選

- 2026 AI 模型怎麼選?7 大場景 × 9 個模型的實戰選型指南 — 不同場景的模型選型建議

- Qwen 3.5 Official Blog — 官方技術報告

- VentureBeat: Qwen3.5-9B beats GPT-OSS-120B — 外媒報導

一句話總結: 9B 參數越級打贏 120B,靠的不是黑魔法,而是混合注意力、早期融合和 RL 下放三個扎實的架構創新。但 benchmark 不等於實戰,跑跑看再說。