殘差連接被動刀了:DeepSeek 和 Kimi 先後改掉 Transformer 用了十年的「默認設定」

殘差連接被動刀了:DeepSeek 和 Kimi 先後改掉 Transformer 用了十年的「默認設定」

作者: Wisely Chen 日期: 2026 年 3 月 系列: AI 前沿技術 關鍵字: Residual Connection, DeepSeek, mHC, Kimi, Moonshot AI, Attention Residuals, Transformer, 架構創新

為什麼我要寫這篇

最近在追論文的時候,發現一個很有意思的現象:2026 年第一季,三個月內,兩家中國實驗室先後對 Transformer 最基礎的零件——殘差連接(Residual Connection)——動了手術。

DeepSeek 的 mHC 在元旦發出來,梁文鋒署名。三個月後 Kimi(Moonshot AI)跟進了 Attention Residuals,馬斯克看完公開評了一句 “Impressive work”。

當這個級別的人點讚一篇基礎架構論文,代表的不只是論文本身,而是它指向的方向。

我不是做基礎研究的,但身為一個長期關注 AI 架構演進的工程師,這件事讓我覺得值得記錄下來。殘差連接這個東西,從 2015 年 ResNet 發明以來,所有人都覺得「就是這樣了,不需要改」。結果現在被改了,而且改得很漂亮。

先講一個比喻,你就懂了

想像 100 位廚師接力做一道菜。第 1 位廚師加了高湯底,第 2 位加了醬油,第 3 位加了一味很特別的香料⋯⋯每位廚師加完自己的調味之後,就把整鍋攪勻,傳給下一位。

傳統的殘差連接就是這個過程:每一層把自己的輸出攪進前面所有層的混合物裡,再傳給下一層。

問題來了:

- 第 80 位廚師想找回第 3 位加的那一味香料? 抱歉,已經被後面 77 位廚師的調味蓋過去了,原味早就找不到了。

- 每位廚師只能嘗到同一鍋混合湯。 但負責煎的和負責燉的需要的底味根本不一樣,他們卻被迫用同一鍋「大雜燴」當基底。

- 越後面的廚師越難影響最終味道。 前面 80 位已經加了那麼多料,第 81 位想讓自己的味道被吃出來?得下比前面所有人加起來還重的手。

這三個問題,十年前不存在。2015 年 ResNet 做到 152 層,殘差連接完美解決了梯度消失,大家公認這個問題「已經被解決了」。但模型從百層變成千億參數、從影像分類變成多步推理之後,規模變了,問題的性質也跟著變了——殘差連接當年沒考慮到的限制,在今天的尺度下開始顯現。

直到今年,有人動手了。

第一刀:DeepSeek 的 mHC

2026 年元旦,DeepSeek 發了一篇論文:mHC(Manifold-Constrained Hyper-Connections)。梁文鋒署名。

他們問的問題是:混合的比例,能不能不要固定?

原本每層傳下來的混合比例是 1:1:1:1——每層的貢獻都一樣重。mHC 讓這個比例變成可學習的。但為了不讓模型在訓練時「學歪」,他們加了一個數學約束:把權重矩陣限制在「雙隨機矩陣」上(每行加起來等於 1、每列加起來也等於 1),保證信號不會爆炸。

用廚房的比喻來說:DeepSeek 讓每位廚師可以調整混合的配比——「第 5 位的調味多保留一點,第 12 位的少放一點」。 但湯還是混在一起的,你只是可以決定混合的比例。

代價:額外 6.7% 的訓練時間。效果:穩定超越原始殘差連接。

一句話總結:把固定配方升級成可調配方,同時用數學確保不會調爆。

第二刀:Kimi 的 Attention Residuals

三個月後,Kimi(Moonshot AI)出手了。馬斯克看完說了一句 “Impressive work”。

Kimi 問的問題更根本:就算配比可以調,整個設計還有什麼沒解決?

他們找到三個答案,每個都很直覺:

問題一:不能點菜

你去餐廳,服務生端來一盤「今日綜合料理」——所有菜混在一起。你說「我只想吃那塊牛排」,服務生說「不行,只有混合餐」。

這就是現在殘差連接的問題。每一層只能收到前面所有層混在一起的結果,不能單獨取用某一層的輸出。mHC 讓混合的比例更靈活了,但本質上你拿到的還是混合餐——只是調味不同。

問題二:資訊一旦混進去,就找不回來了

把一滴紅墨水滴進一杯水裡,攪勻。現在請你把紅墨水取回來。

做不到。這就是殘差連接的「資訊稀釋」問題。某一層學到了很有價值的特徵,但一旦被混進累積狀態,隨著後面幾十層不斷疊加,這個特徵越來越淡,最終被淹沒。不可逆。

問題三:越後面的層越沒有存在感

想像你在一間派對裡。前 80 個人都已經在聊天了,房間已經很吵。你是第 81 個到場的人,想讓大家聽到你說話?你得喊得比前面 80 個人加起來還大聲。

Kimi 的論文實際測量了這個效應:到模型最後幾層,信號量級是最開始的十多倍。後面的層要產生同等影響,得付出十倍以上的「音量」。

Kimi 的解法:一個很漂亮的類比

這三個問題——不能點菜、資訊找不回來、後面的層越來越難發聲——是不是有點眼熟?

如果你知道 2017 年之前的 NLP 是怎麼做的,你會覺得似曾相識。

那時候用的是 RNN(循環神經網路)。處理一段文字時,也是把所有歷史資訊壓縮進一個狀態,一步一步往前推。同樣的問題:前面的字被稀釋、後面的字越來越難影響結果、不能選擇性地回頭看早期內容。

2017 年,《Attention Is All You Need》提出了 Transformer,用注意力機制解決了這個問題。每個位置可以直接回頭看所有之前的位置,根據當前內容動態決定要關注哪裡。

但有意思的是:那篇論文升級了「文字之間」的資訊流,卻完全沒動「層與層之間」的資訊流。 殘差連接依然是 2015 年的固定累加,原封不動地活了九年。

Kimi 的洞察是:

處理文字時,我們已經用注意力替代了「壓縮傳遞」。那層與層之間,為什麼還在用「壓縮傳遞」?

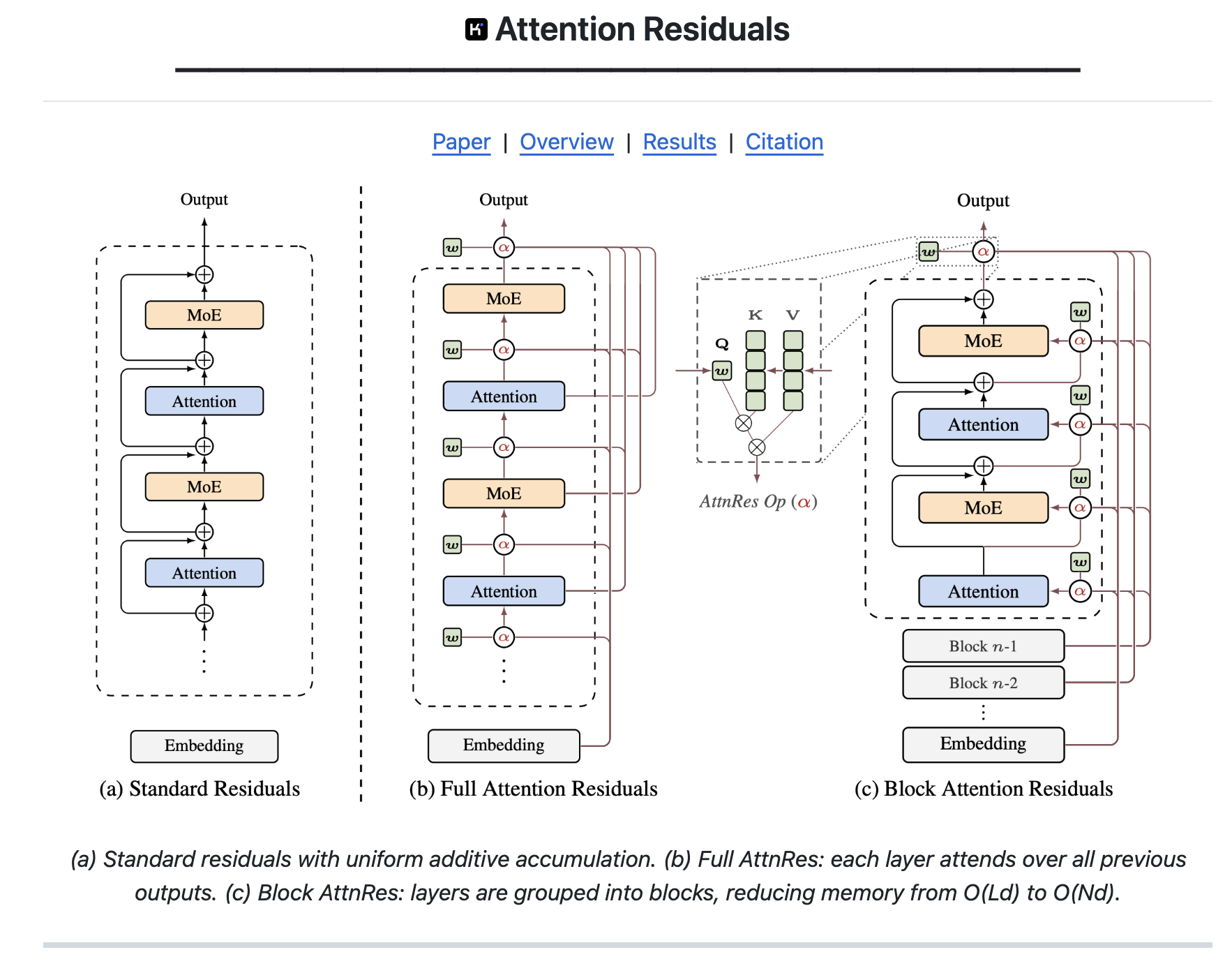

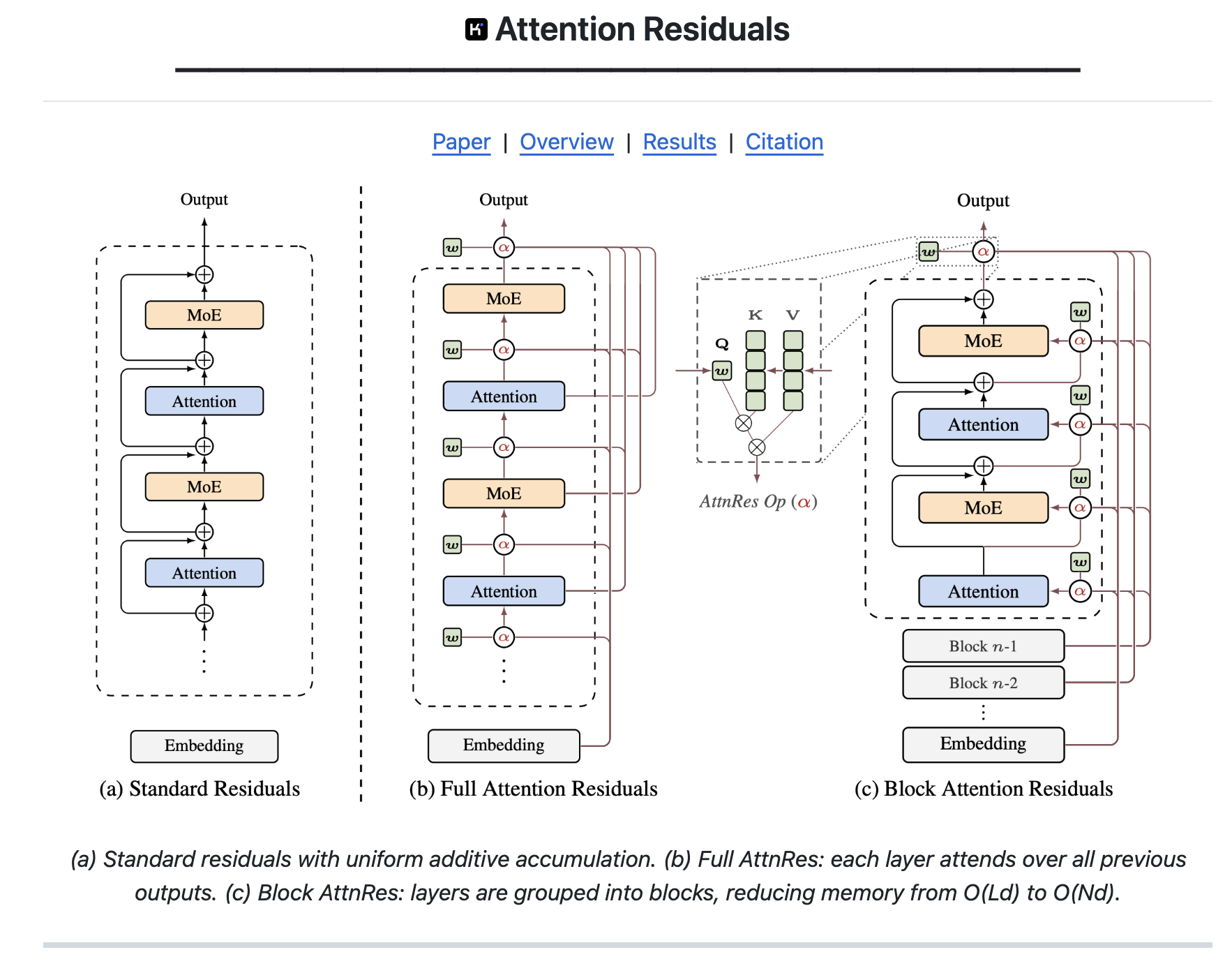

所以他們做了一件很直覺的事:把注意力機制用到層與層之間的連接上。

回到廚房的比喻:Kimi 在每位廚師面前放了一個試味架,上面擺著前面每位廚師的「原味樣本」。 現在第 100 位廚師覺得「第 3 位當時加的那味香料我現在要用」,可以直接從試味架上舀一口原味,不用再從那鍋被改了 97 遍的混合湯裡猜。而且每位廚師會根據自己要做的菜,自己決定重點參考誰的味道——不是固定的,是看情況來的。

參數代價?每一層只多了一個向量。幾乎可以忽略。

直接對比:兩把刀的差異

| DeepSeek mHC | Kimi AttnRes | |

|---|---|---|

| 改的是什麼 | 混合調味的配比 | 整個傳菜的結構 |

| 權重是活的還是死的 | 訓練完就固定(靜態) | 每次處理不同輸入都不同(動態) |

| 能看到什麼 | 只能看到混合過的狀態 | 可以直接看所有前面層的原始輸出 |

| 解決了什麼 | 配比太死板 | 不能點菜 + 資訊被淹沒 + 後面層沒聲音 |

| 訓練額外開銷 | 6.7% | < 4% |

論文裡有一個消融實驗特別有說服力:讓模型能看到所有之前層的輸出,但權重是固定的(訓練完就不變)——效果幾乎沒提升。換成動態權重(根據當前內容實時決定)——性能明顯提升。

結論很清楚:光是「能回頭看」不夠,必須是「根據內容動態地回頭看」才有價值。

工程落地:Block AttnRes

理論很美,但 100 多層的模型,每一層都存著所有前面層的輸出?記憶體吃不消。

Kimi 的工程方案是 Block AttnRes:把所有層分成大約 8 個「區塊」,區塊內還是用標準殘差累加,區塊與區塊之間用注意力。

好比把 100 位廚師分成 8 組。組內還是傳統的攪勻傳遞,但組與組之間放試味架。你不需要保留每位廚師的原味樣本,只要保留每一組的匯總味道就好。

性能損失?幾乎可以忽略。8 個區塊就恢復絕大部分收益。推理延遲增加不超過 2%。

實測數字

在 Kimi 自家的 48B 參數模型上驗證:

最直觀的一個數字:用同樣的算力,AttnRes 達到了標準方法需要多燒 25% 算力才能達到的性能。

不加機器、不加數據,只改資訊流的結構,白賺 25%。

下游任務的提升,尤其推理類最顯著:

| Benchmark | 改之前 | 改之後 | 提升 |

|---|---|---|---|

| GPQA-Diamond(研究生級科學推理) | 36.9 | 44.4 | +7.5 |

| 數學 | 53.5 | 57.1 | +3.6 |

| 程式碼 | 59.1 | 62.2 | +3.1 |

| 中文理解(C-Eval) | 79.6 | 82.5 | +2.9 |

推理任務提升最大,這說得通——多步推理需要不同層之間緊密協作,正是資訊流改善受益最大的場景。

模型自己學到了什麼?三個有意思的發現

訓練完之後,Kimi 把模型「回頭看」的模式視覺化了。結果很有意思:

一、大部分時候,還是嘗最近一位的味道。 標準殘差的「只看上一層」並不完全錯,模型自己學出來也是以鄰近層為主。就像做菜時,最常參考的還是上一手剛加的調味。

二、但最原始的高湯底一直沒被忘掉。 即使到了第 100 位廚師,對最開頭那鍋高湯底的注意力權重都不是零。標準殘差下這個原味早被稀釋得找不到了,AttnRes 讓最後一位廚師還能隨時回頭舀一口最初的高湯。就像不管菜做到哪個階段,偶爾還是得回去確認客戶最初要的是什麼味道。

三、模型自己發明了「捷徑」。 某些廚師會跳過中間好幾位,直接去嘗很早期某位廚師的原味樣本。這不是人工設計的,是訓練中模型自己發現的最佳路徑——因為它知道那一味對當前的菜最關鍵。

往大了說

過去幾年大模型的架構創新,主要發生在「菜色研發」——Attention 機制的各種變體、MoE 的路由策略、位置編碼的改進。但殘差連接——廚房裡最基本的「傳菜流程」——一直沒人覺得需要碰它。

現在 DeepSeek 和 Kimi 先後在傳菜流程上找到突破口。這說明一個趨勢:架構優化的前沿已經從菜色研發深入到廚房動線了。

《Attention Is All You Need》當年把「文字之間的資訊流」從遞推升級到注意力。但那篇論文裡的殘差連接——「層與層之間的資訊流」——依然用的是 2015 年的固定累加。

這個未完成的工作,等了九年。

2026 年第一季,三個月內,兩家中國實驗室先後在這個最基礎的地方找到了根本性突破。不管你關注的是技術趨勢還是產業競爭,這件事都值得記下來。

對我來說,最大的啟發是:有時候最大的優化空間,藏在所有人都覺得「不需要改」的地方。 這個邏輯不只適用於模型架構,也適用於工程實踐、團隊流程、產品設計。