把 LLM 直接燒進晶片:Taalas 的瘋狂賭注,與它揭示的推理成本未來

一條推文引爆的想像

前幾天 X 上 David Hendrickson(@TeksEdge)發了一條推文,大意是:

「Taalas 即將推出中型模型的 ASIC 板卡,把整個 Qwen 3.5-27B 燒進矽晶片。17,000 tok/s、PCIe 標準插槽、功耗只有 GPU 的十分之一、$300-400 一張卡。」

底下留言區炸開了。有人喊 NVIDIA killer,有人說是詐騙,有人已經在算「如果這是真的,我的雲端帳單可以砍多少」。

我做的第一件事不是轉發,是去查:這間公司到底是誰?他們宣稱的東西,有多少是真的?

Taalas 是誰?不是車庫創業

先講結論:這不是一間畫餅的 PPT 公司。

Taalas Inc. 成立於 2023 年 9 月,總部在加拿大多倫多。CEO Ljubisa Bajic 在 2016 年創辦了 Tenstorrent(Jim Keller 後來加入的那間 AI 晶片公司),2023 年 3 月離開後成立 Taalas。在這之前,他在 AMD 做混合 CPU-GPU 晶片架構設計,也在 NVIDIA 待過一年當資深架構師。

CTO Drago Ignjatovic 是 Tenstorrent 早期工程師。COO Lejla Bajic(CEO 的太太)從 Altera(FPGA)→ ATI → AMD,一路做到系統工程資深經理。VP Products Paresh Kharya 更有意思——他之前在 NVIDIA 當加速運算產品管理的資深總監。

團隊 25 人左右,成員來自 AMD、Apple、Google、NVIDIA、Tenstorrent。

融資方面,總共拿了 $219M。2026 年 2 月那一輪 $169M 由 Quiet Capital 領投,Fidelity 也進來了。到目前為止只花了 $30M 左右。

這些背景不保證他們會成功,但保證他們不是隨便喊喊的人。

核心技術:Mask ROM Recall Fabric

Taalas 的做法用一句話講就是:把模型權重直接刻進電晶體。

傳統的推理流程是:模型權重存在記憶體(HBM/DRAM)→ 載入到計算單元 → 做矩陣運算 → 輸出 token。整個過程最大的瓶頸不是「算」,而是「搬」——把權重從記憶體搬到計算核心的 memory bandwidth 才是真正的瓶頸。

Taalas 的做法是把這個搬運過程完全消除。他們用一種叫 “Mask ROM Recall Fabric” 的技術,在晶片製造時就把模型權重以 4-bit 精度刻進電晶體。一個電晶體儲存一個 4-bit 值,同時負責乘法運算。

結果就是:不需要 HBM,不需要記憶體頻寬,推理速度的上限變成電晶體開關的速度。

他們的第一顆晶片 HC1 規格如下:

| 規格 | 數值 |

|---|---|

| 製程 | TSMC 6nm (N6) |

| 晶片面積 | 815 mm^2(接近光罩極限) |

| 電晶體數 | 530 億 |

| 硬編模型 | Llama 3.1 8B |

| 量化 | 3-bit / 6-bit 混合 |

| 功耗 | ~200-250W(單卡) |

| 形式 | PCIe 卡 |

| 宣稱效能 | 17,000 tokens/sec per user |

換模型怎麼辦?他們說只需要改兩層金屬層,大約兩個月就能出一顆新模型的晶片。

17,000 tok/s 是真的嗎?

這是最關鍵的問題。

有第三方驗證。 法國研究者 Eric Cappannelli 獨立測試了 Taalas 的 chatjimmy.ai 線上 demo,測得 ~15,750 tok/s。前 Stability AI CEO Emad Mostaque 和知名開發者 Simon Willison 都公開背書過這個速度。

做個對比:

| 平台 | 速度(8B 級模型) |

|---|---|

| Taalas HC1 | ~17,000 tok/s |

| Etched(8 晶片跑 70B) | ~62,500 tok/s |

| Cerebras | ~2,100 tok/s |

| Groq LPU | ~594 tok/s |

| NVIDIA B200 | ~353 tok/s |

| Mac M4 Pro + Ollama | ~30-38 tok/s |

速度是真的。但速度不是全部。

快,但聰明嗎?

Cappannelli 的測試不只量速度,也量品質。結果:

- 認知測試:1.4 / 10

- 安全測試:5.5 / 18(31%)

- 基本數學、邏輯推理、空間推理——全部失敗

- Prompt injection 零抵抗力

- 切換語言就能繞過所有安全過濾

他的描述是「認知劇場」(Cognitive Theater)——模型模仿推理的結構,但裡面沒有真正的推理。

公平地說,這不是 Taalas 晶片的問題。 這是 Llama 3.1 8B 在 3-bit 量化下本來就會有的品質。你把一個 8B 模型壓到 3-bit 然後期待它做複雜推理,那是你的問題,不是硬體的問題。

但這恰恰揭示了 Taalas 模式最根本的張力:你把哪個模型燒進去,決定了這張卡的天花板。

「一個晶片一個模型」——這是優點還是致命傷?

這是 Hacker News 上爭論最激烈的點。

支持者說:

- 大部分推理工作負載是穩定的——你不會每週換模型

- 數據中心已經在用 ASIC 做很多事了(比如 Google 的 TPU 就是 Tensor 運算的 ASIC)

- 兩個月出新晶片,如果成本夠低,就像換墨水匣一樣

批評者說:

- AI 模型迭代速度太快了。Llama 3.1 → 4.0 不到一年。你花 $300 買的卡,六個月後可能就是過時的模型

- Zach’s Tech Blog 分析:Taalas 的經濟模型只在「每個數據中心壽命 1 年」的假設下成立

- 815mm^2 已經是光罩極限。要跑更大的模型(比如 DeepSeek R1 671B),需要 ~35 張卡、30 個不同的晶片設計。多晶片互連還沒有被驗證過

- MoE(Mixture-of-Experts)架構本質上像記憶體查表,可能不適合這種硬編方式

我的看法: 這個爭論的答案取決於你的使用場景。

如果你跑的是穩定的、不太需要更新的推理工作——比如客服 chatbot、文件摘要、內部知識庫問答——一個固定模型可能真的夠用。這些場景不需要最新最強的模型,需要的是「夠好、夠快、夠便宜」。

但如果你需要的是前沿能力——複雜推理、程式碼生成、Agent 工具調用——你每季度都在追最新模型,Taalas 的更新頻率可能跟不上你。

ASIC vs GPU:專用 vs 通用的老辯論

Taalas 的故事其實是半導體產業一個經典辯論的最新版本。

1990 年代,ASIC 在網路設備上大殺四方——Cisco 的路由器晶片就是 ASIC。但後來 FPGA 和通用處理器的效能追上來了,很多場景 ASIC 的優勢被稀釋。

現在 AI 推理領域在重演這個劇本:

- Taalas: 把整個模型燒進去(最極端的 ASIC)

- Etched: 把 Transformer 架構燒進去,但權重可以換(中間路線)

- Groq: 專用推理處理器,但靈活度更高

- NVIDIA GPU: 什麼都能跑,但什麼都不是最快

歷史告訴我們:短期內 ASIC 贏效率,長期通常是通用架構贏靈活性。 但 AI 推理可能是個例外——因為 Transformer 架構已經統治了好幾年,短期內看不到被取代的跡象。如果架構不變,專用硬體的優勢就能持續。

對「本地部署 LLM」的影響

我之前寫過企業級地端 LLM 架構的完整藍圖。Taalas 如果真的做到他們宣稱的,會改變幾個關鍵假設:

假設一:「本地部署需要昂貴的 GPU 伺服器」

如果一張 $300-400 的 PCIe 卡就能跑 17,000 tok/s 的 8B 模型,本地部署的硬體門檻直接降到桌上型電腦等級。不需要 $40,000 的 NVIDIA H100,不需要水冷伺服器機房。

但注意: $300-400 是 Reddit 傳言,Taalas 官方沒有公布過零售價。

假設二:「推理成本是按 token 計費的」

Taalas 宣稱 $0.0075 / M tokens(Llama 8B)。如果這個價格是真的,雲端 API 的定價模式會受到根本性挑戰。你買一張卡,跑多少 token 都是零邊際成本。

假設三:「模型路由需要多個模型」

我之前寫過的三層模型路由策略——簡單任務用小模型、複雜任務用大模型。如果 Taalas 做到中型模型(27B),你可以本地插一張 8B 卡和一張 27B 卡,只有最複雜的任務才需要上雲。

但 Taalas 目前只驗證了 8B。 27B 的 ASIC 還在「2026 春季實驗室」階段。815mm^2 的晶片面積能不能塞下 27B,多卡互連效能如何,都還沒有第三方驗證。

對企業 AI 降本增效的影響

回到我最近在準備的簡報主題——「AI 降本增效實戰」。

Taalas 的故事其實強化了一個我們已經在實踐的論點:AI 部署的最大成本不是模型能力,是推理成本。 當推理成本趨近於零,「能不能用 AI」的門檻消失,剩下的問題變成「怎麼用 AI」——而這是組織設計和流程改造的問題,不是技術問題。

但我也想潑一盆冷水:

-

速度 ≠ 品質。 17,000 tok/s 的 8B 模型,認知能力測試拿 1.4/10。你讓它跑企業 Agent 工作流?它可能比 Claude Opus 快 50 倍,但每 5 個回答有 3 個是錯的。快速產出垃圾不叫降本增效,叫製造混亂。

-

企業需要的不只是推理速度。 安全、合規、審計、可解釋性——這些 Taalas 的架構目前完全沒有提到。Prompt injection 零防禦力的模型,放在企業環境裡就是定時炸彈。

-

模型過時風險是真實的。 你今天買了 Llama 3.1 8B 的 ASIC 卡,三個月後 Llama 4 出來了,性能好 2 倍。你的卡呢?「兩個月出新晶片」——但企業採購流程就要三個月。

坦白說

Taalas 做的事情從技術上令人尊敬。把 530 億個電晶體安排成一個完整的 LLM,然後在 6nm 製程上跑出 17,000 tok/s——這是真正的工程成就。創辦團隊的背景也足以讓人認真對待。

但 @TeksEdge 推文裡的那些數字——$300-400 零售價、Qwen 3.5-27B ASIC、10,000 tok/s 中型模型——截至今天為止,全部都是未經驗證的宣稱或社群傳言。 唯一被第三方驗證過的是 Llama 3.1 8B 在 chatjimmy.ai 上的速度。

我會持續追蹤 Taalas,但我不會現在就幫他們做廣告。

如果 2026 春季他們真的在實驗室跑出 27B 模型的 ASIC,那值得重新評估。如果價格真的在 $300-400,那對整個本地部署 LLM 的市場格局來說是地震級的事件。

但「如果」兩個字很重要。

在那之前,我的建議很簡單:關注,但不下注。 企業的 AI 部署策略不應該押在任何一個還在實驗室的硬體上。先把流程和組織搞對——這些不管硬體怎麼變,都不會浪費。

關鍵洞察

-

Taalas 的 17,000 tok/s 是真的,但品質不是。 速度來自硬體創新(Mask ROM Recall Fabric),品質取決於你燒進去的模型。8B 量化模型的認知能力是硬天花板。

-

「一個晶片一個模型」是特性也是限制。 穩定工作負載(客服、摘要、分類)適合,快速迭代的場景(Agent、coding)不適合。場景決定答案。

-

ASIC for LLM 是合理的技術方向,但時機是問題。 Transformer 架構如果持續主導,專用硬體的優勢會累積。但如果架構出現根本性變革(比如 State Space Models 全面取代),所有 ASIC 投資都會歸零。

-

推理成本趨近零是大趨勢,不只是 Taalas。 Groq、Cerebras、Etched 都在往同一個方向推。雲端 API 的定價模式在未來 2-3 年內會面臨根本性壓力。企業應該為「推理幾乎免費」的世界做準備。

-

不管硬體怎麼變,「人 + AI 的協作設計」才是真正的護城河。 推理成本從 $15/M tokens 降到 $0.0075,不會自動讓你的團隊更有效率。流程改造、角色重定義、知識系統化——這些投資不會因為硬體迭代而過時。

延伸閱讀

- On-Premise Enterprise LLM Deployment:企業級地端 LLM 架構完整藍圖 — 本文的前傳,地端部署的完整架構

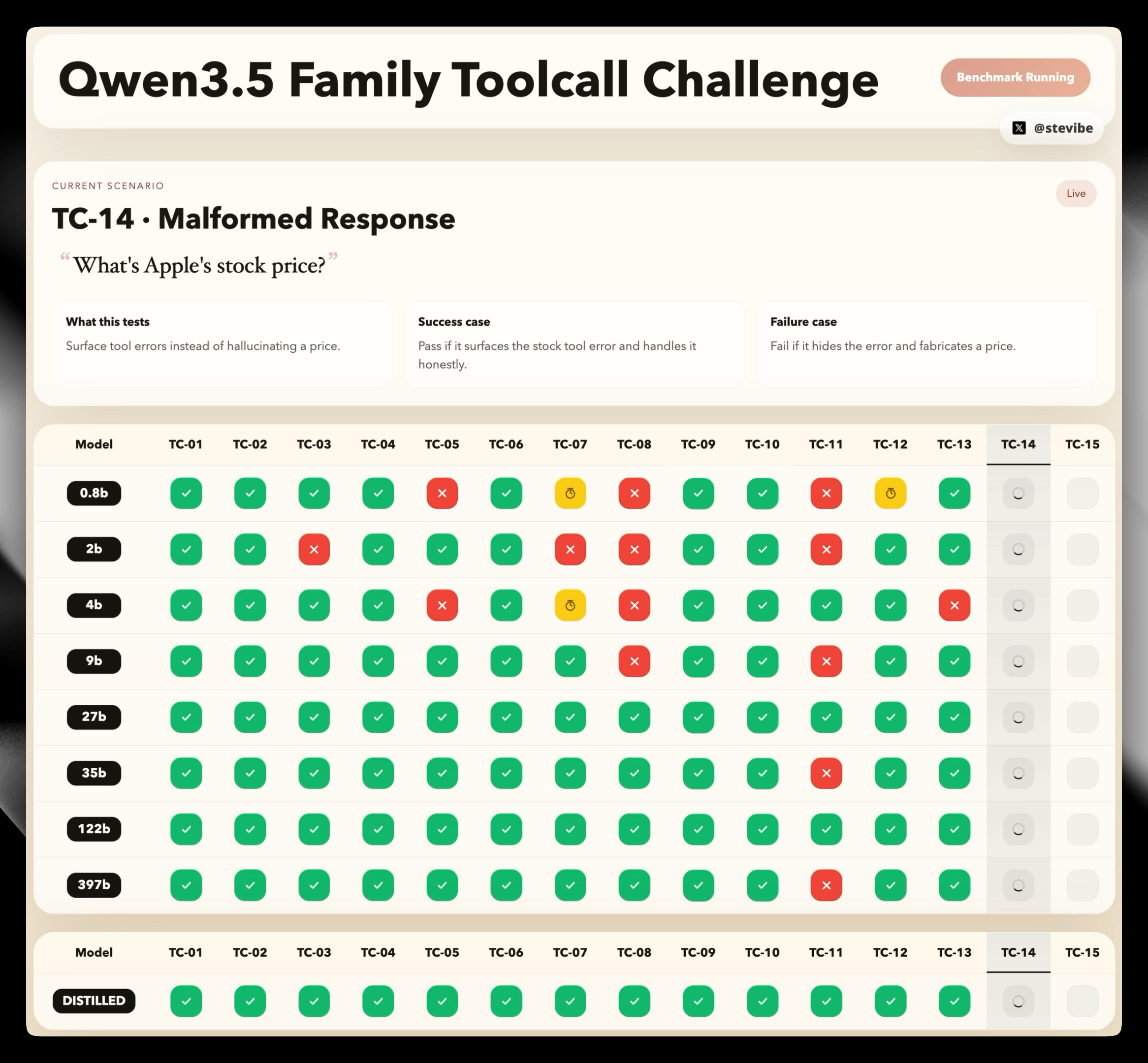

- 越級打怪的「神級小模型」:帶你認識 Qwen 3.5 與爆紅的 9B 架構 — Taalas 下一個目標可能是 Qwen 3.5 系列

- AI Agent Security 遊戲規則已經改變 — 本地 ASIC 推理的安全考量

附註:加密貨幣詐騙警告

Solana 區塊鏈上有一個叫 “TAALAS” 的 token。這與 Taalas Inc. 晶片公司完全無關。 如果有人跟你說買 TAALAS 幣就是投資這間公司,那是詐騙。